Содержание

- Зачем проверять юзабилити сайта

- Чек-лист юзабилити сайта

- Технические параметры юзабилити

- Изменения дизайна для юзабилити

- Навигация и интерфейс для юзабилити сайта

- Оптимизация работы с товаром для юзабилити сайта

- Аудит юзабилити сайта от специалистов Roistat

- Итоговые рекомендации по проверке юзабилити сайта

Объясняем, как неудобный для пользователей сайт может влиять на бизнес-показатели компании и с помощью каких сервисов можно найти и исправить ошибки юзабилити.

Юзабилити сайта (usability — удобство использования) — это оценка удобства работы пользователей с сайтом. Посетителю должно быть понятно, как найти нужную информацию, как не запутаться в страницах и как выполнить целевые действия — оставить заявку, позвонить и купить нужный продукт или услугу.

Зачем проверять юзабилити сайта

На неудобном, сложном сайте с долгой загрузкой сложно сделать заказ. Пользователь скорее уйдёт, чем будет разбираться, куда нажимать, чтобы посмотреть товар, оформить заказ или узнать контакты компании. Согласно исследованию Intechnic, 70% пользователей откажутся от покупки, если им не понравился сайт.

Хотите освоить сквозную аналитику?

Посетите регулярный мастер-класс по аналитике от Roistat.

Подключиться

Сайты с хорошим юзабилити помогают быстро и просто оставить заявку и приобрести продукт. Компании подумали о пользователях: добавили расширенный поиск, возможность заказа в один клик, составили понятные карточки товаров, предусмотрели ещё десятки незаметных опций. Всё для того, чтобы пользователь почувствовал заботу и потратил минимум времени на покупку.

Проверять юзабилити сайта и исправлять ошибки необходимо. Так компания устраняет препятствия на пути пользователя к покупке, повышает конверсию в заказы и оплаты и получает больше прибыли.

Чек-лист юзабилити сайта

Технические параметры юзабилити

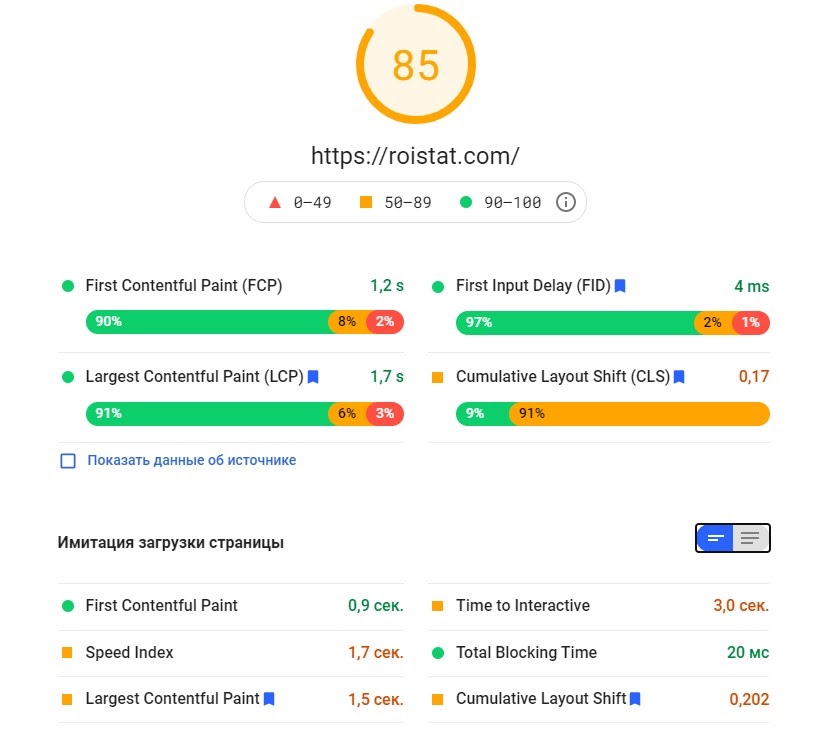

1. Скорость загрузки. Google провёл исследование: если страница грузится до 5 секунд, вероятность отказа повышается на 90%. Пользователи не хотят ждать и закрывают вкладку. Картинки, анимация, видео увеличивают вес сайта — используйте их в меру. Сайт должен грузиться 1-2 секунды.

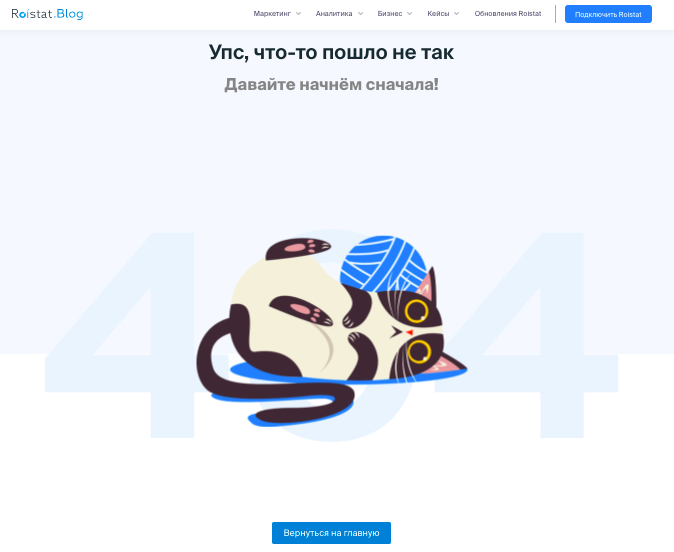

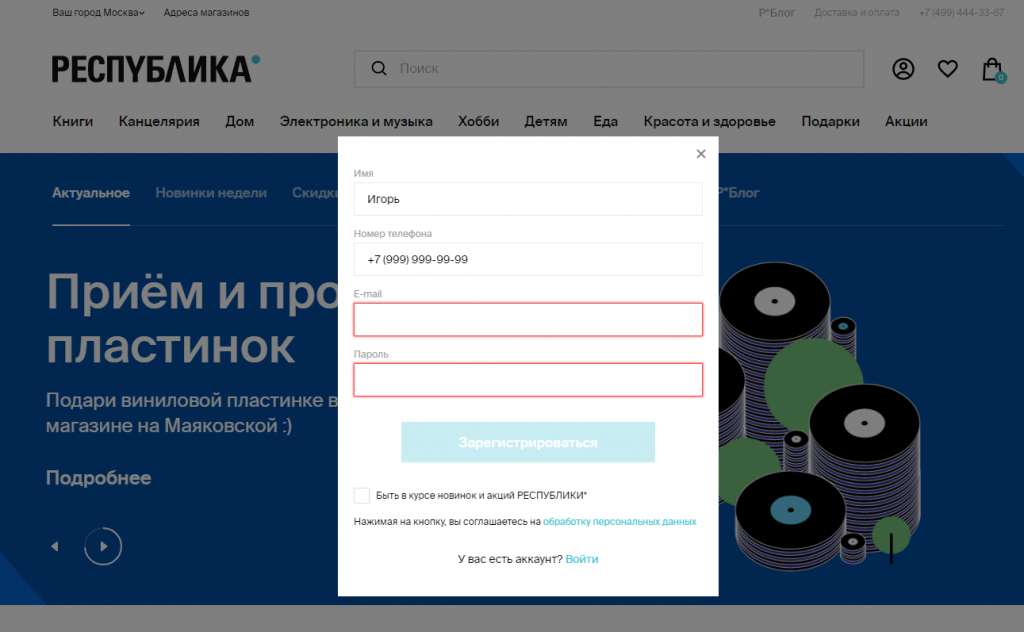

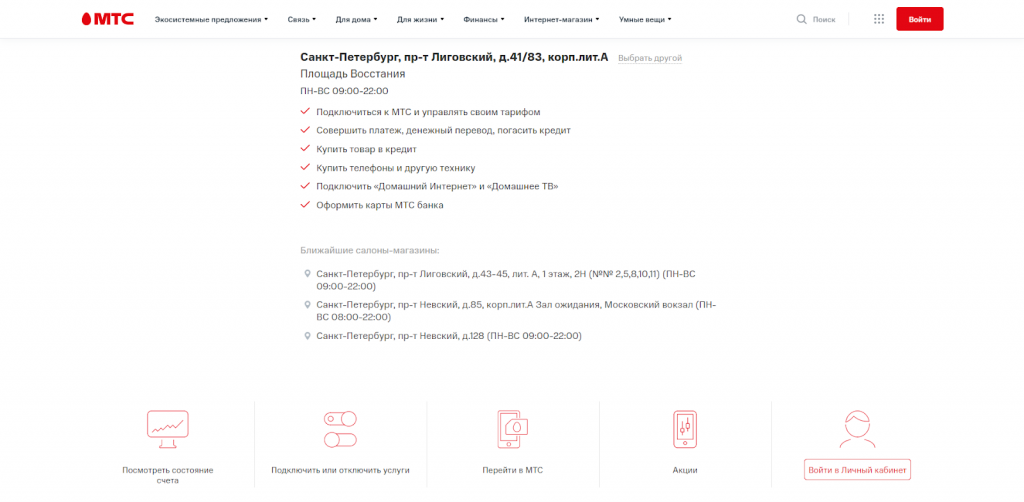

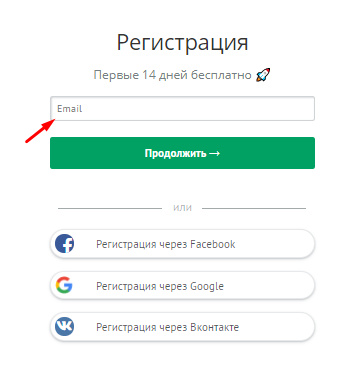

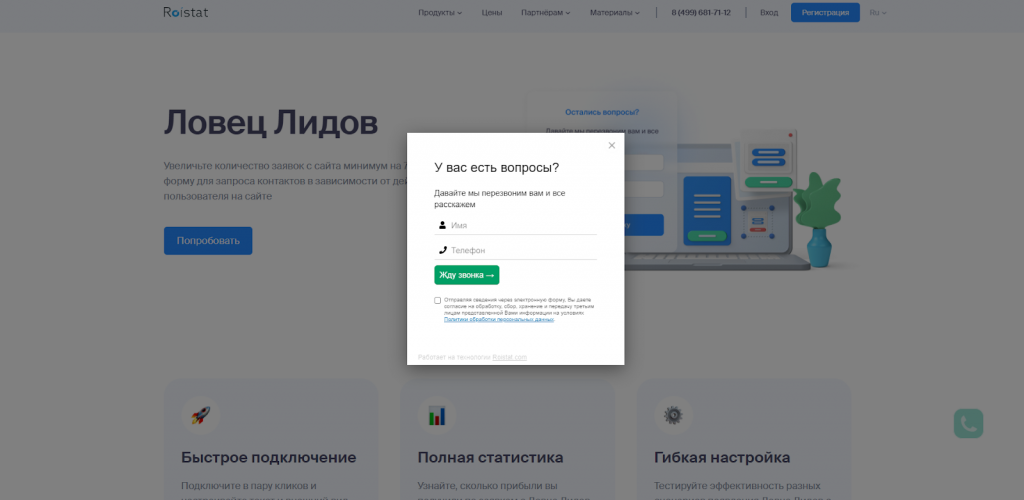

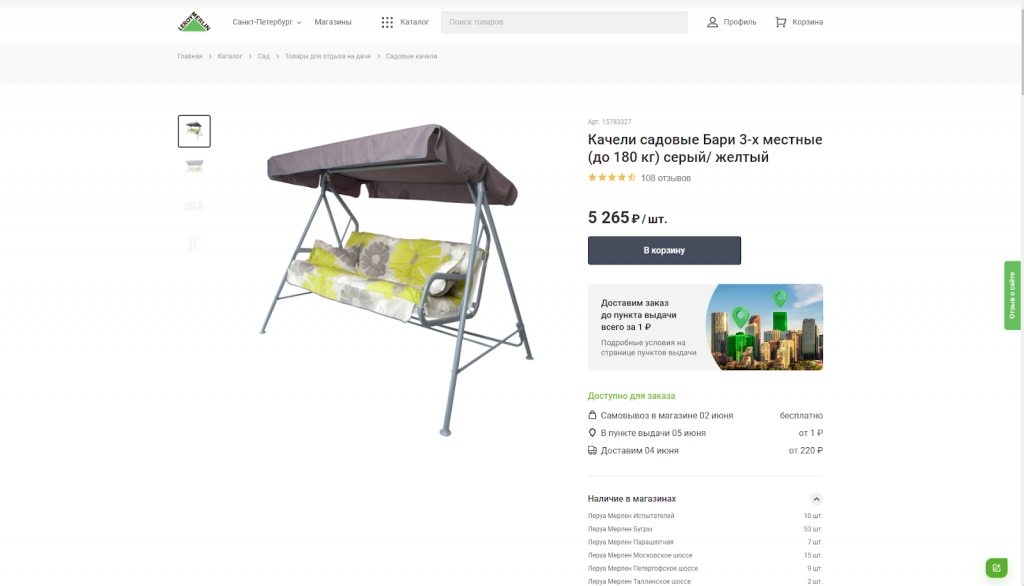

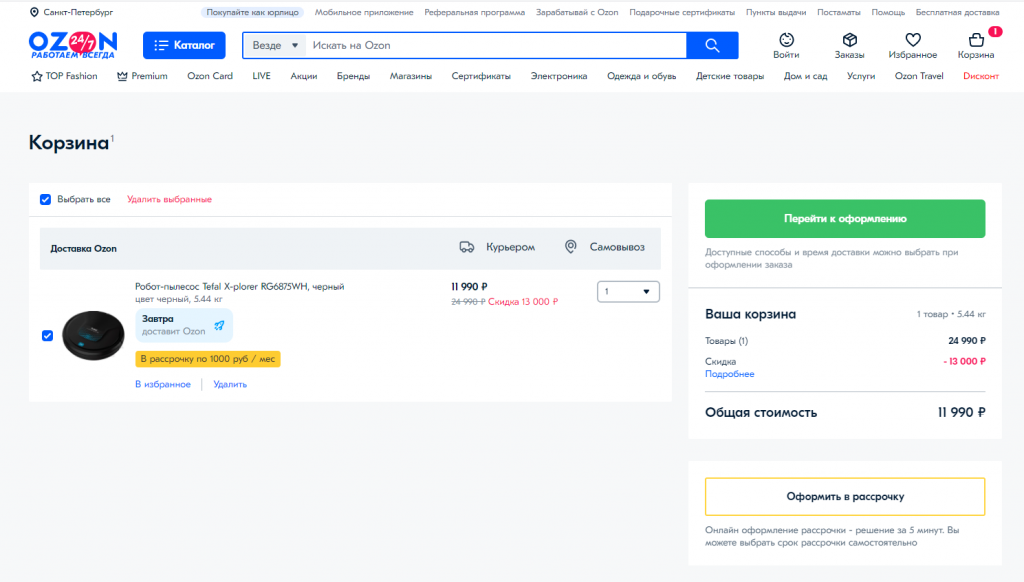

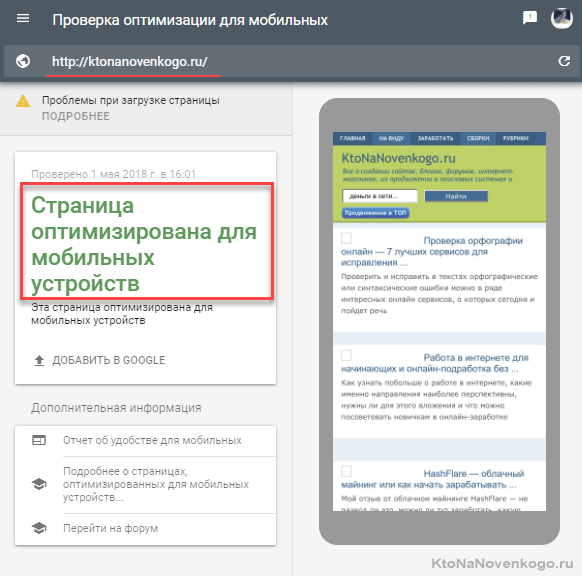

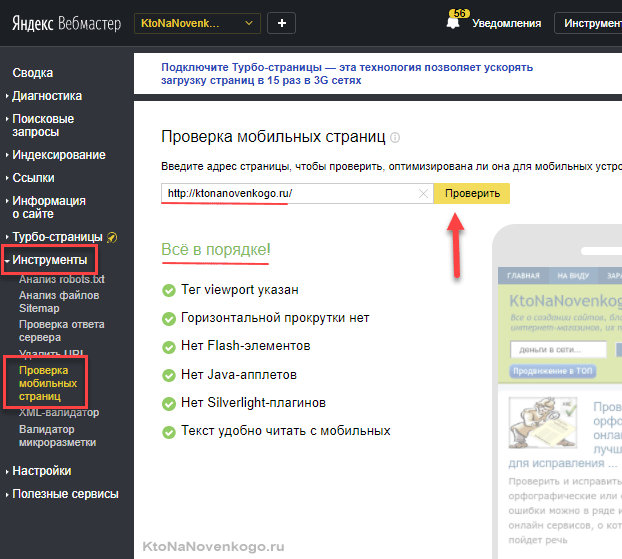

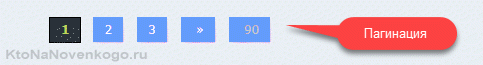

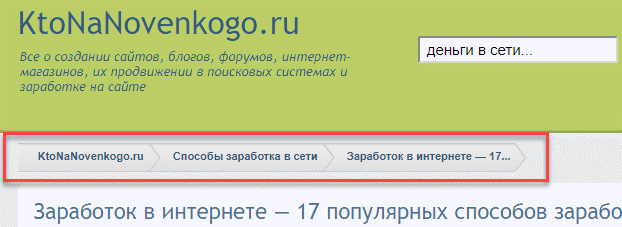

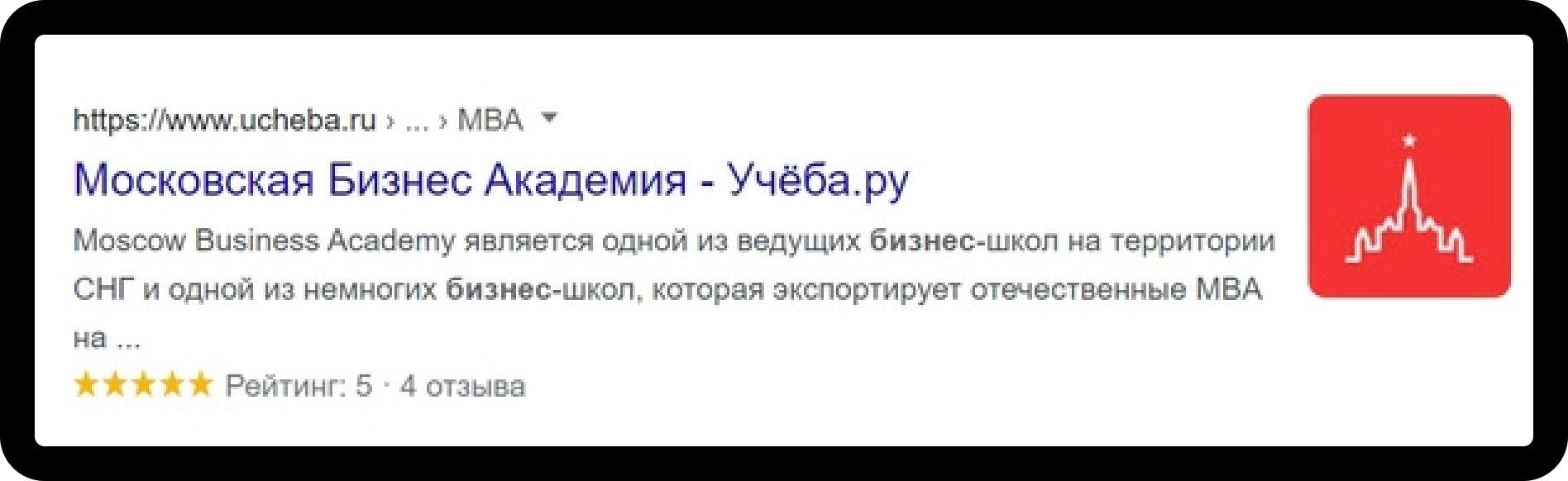

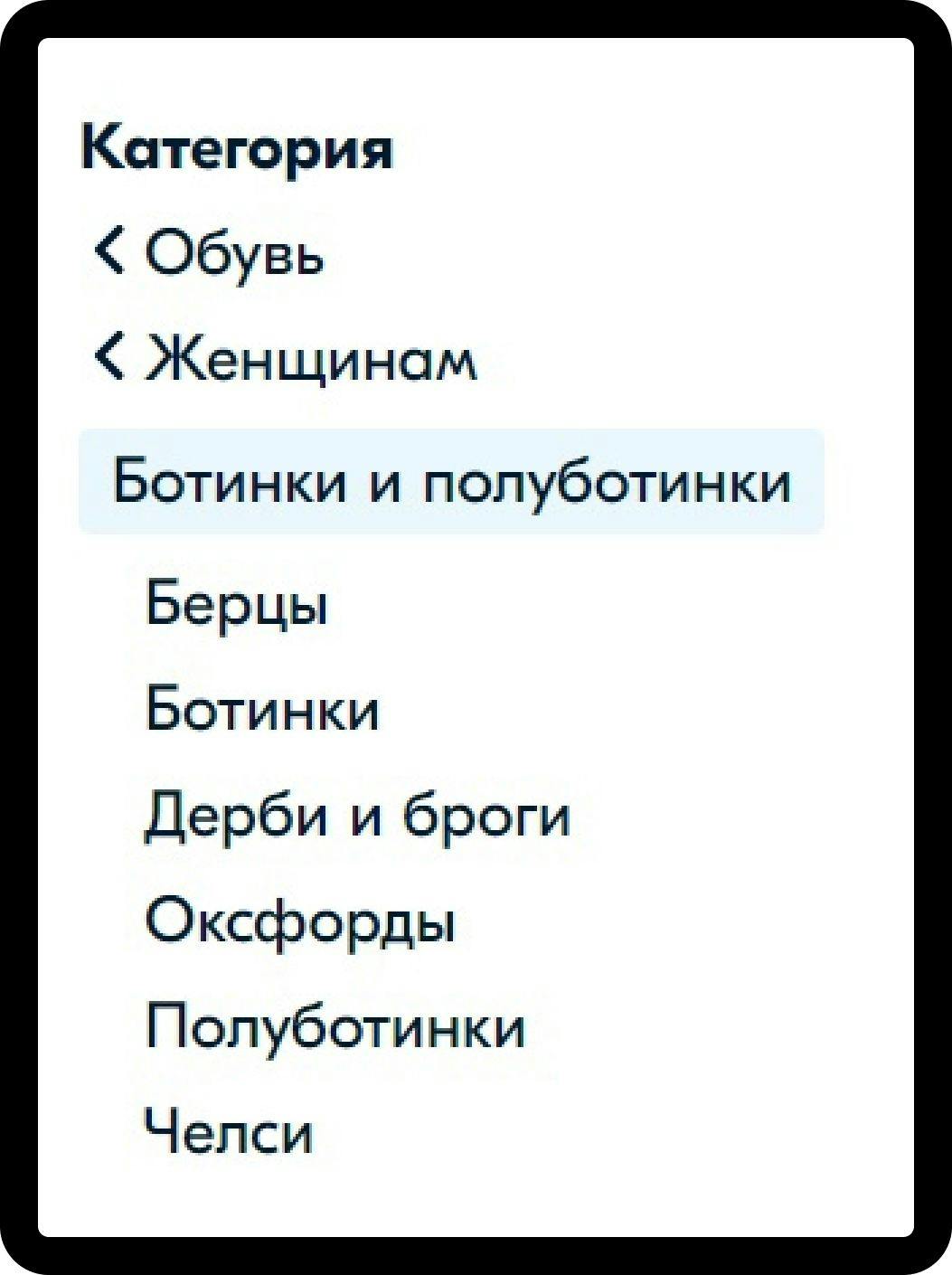

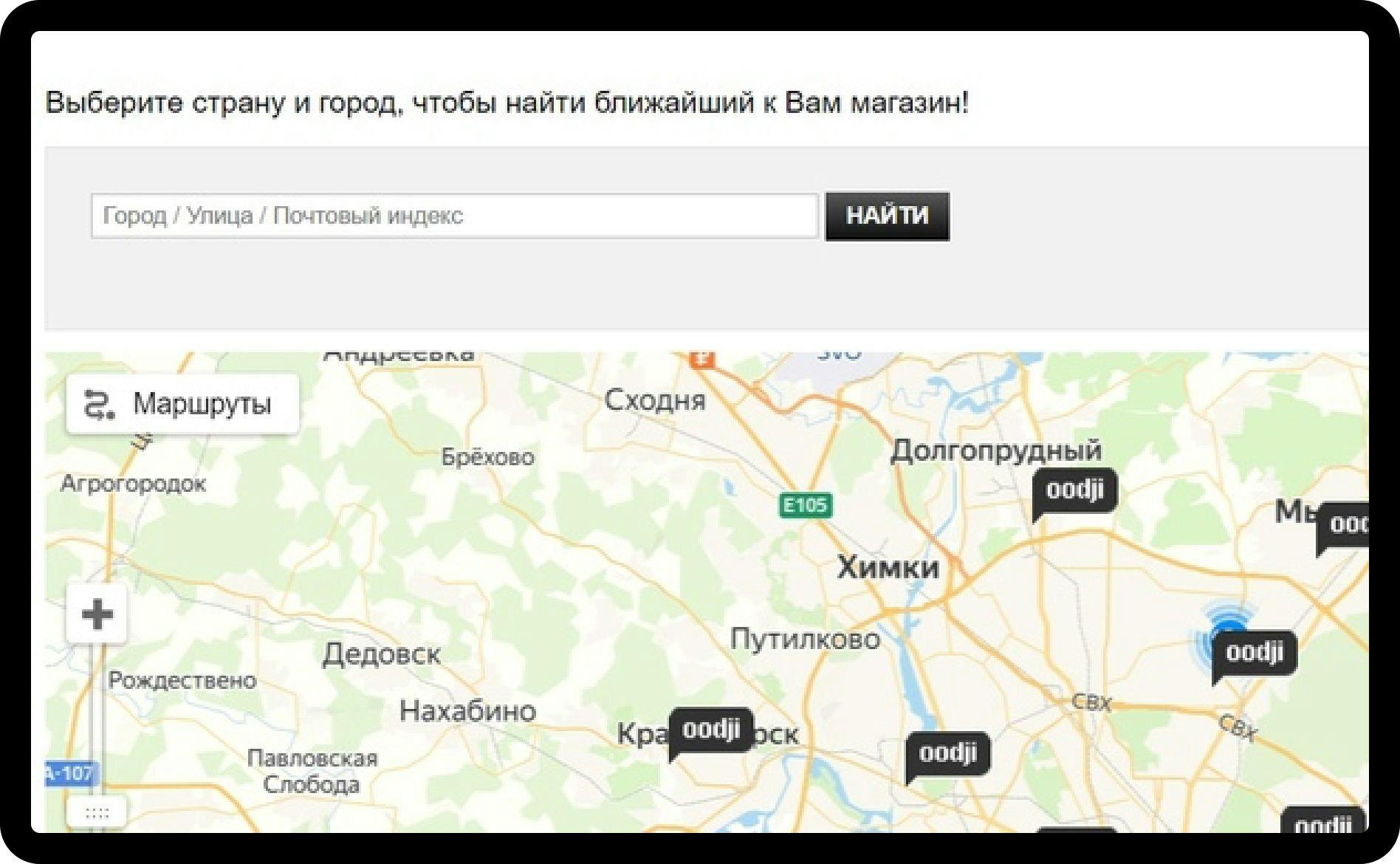

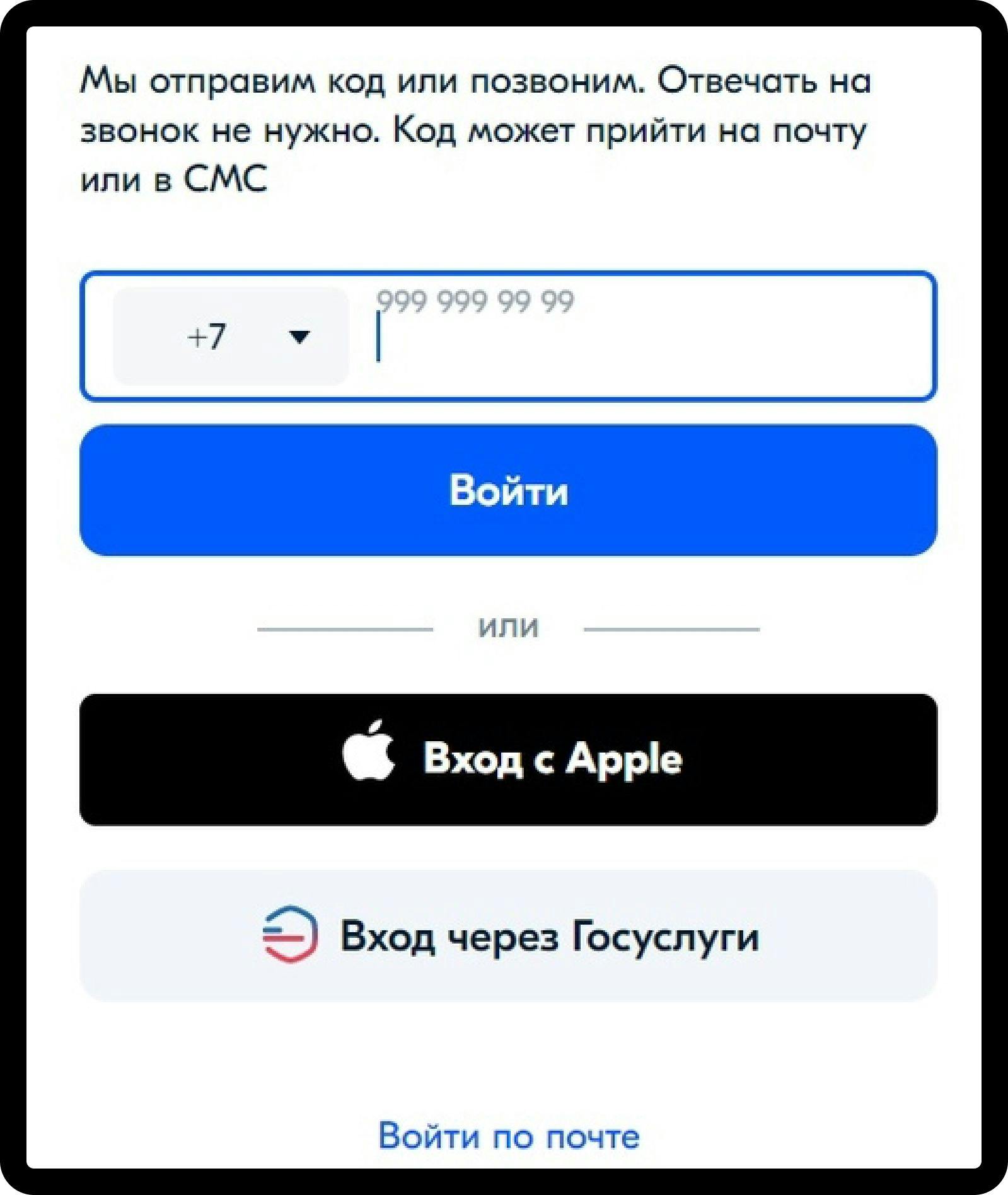

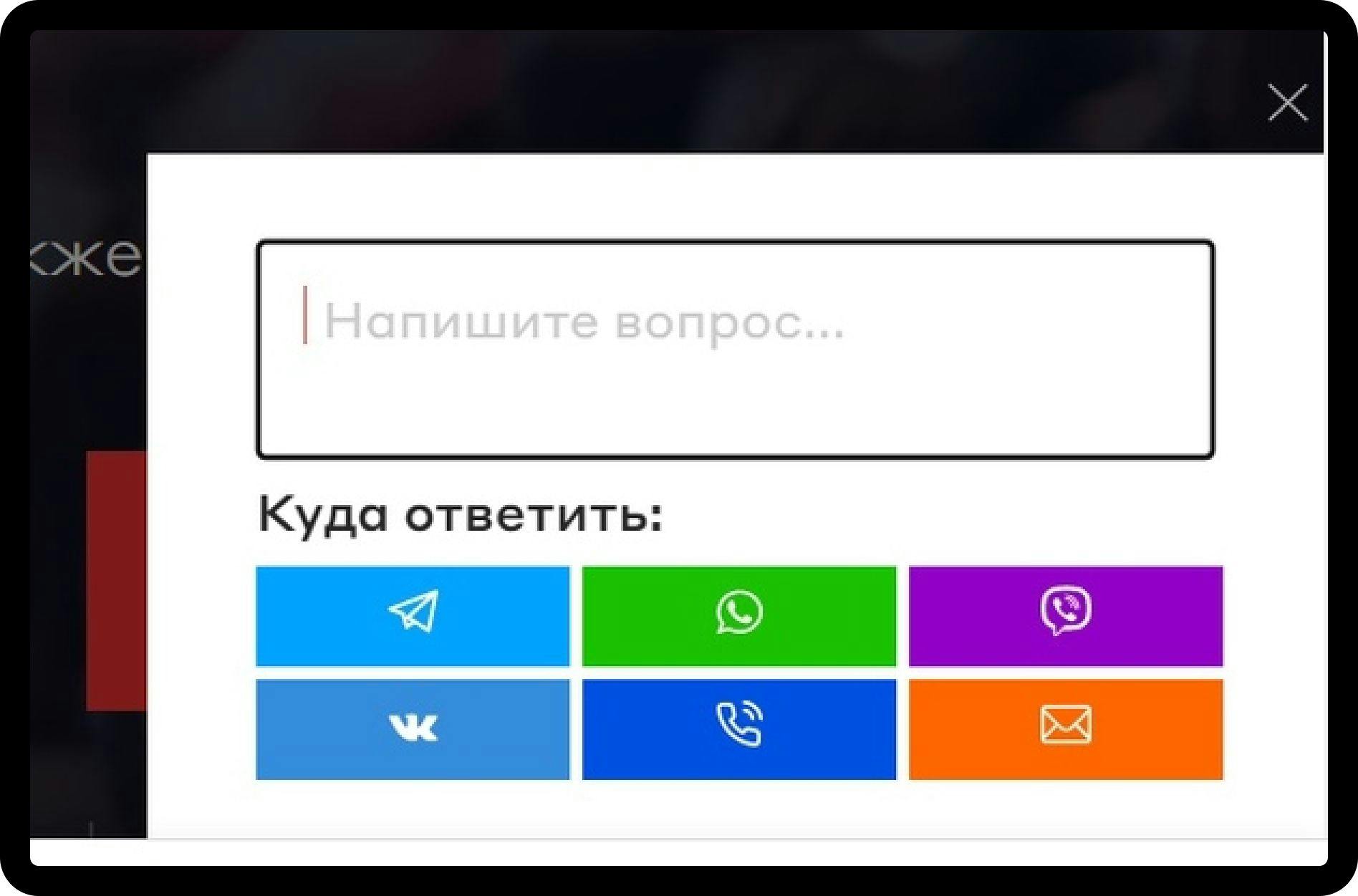

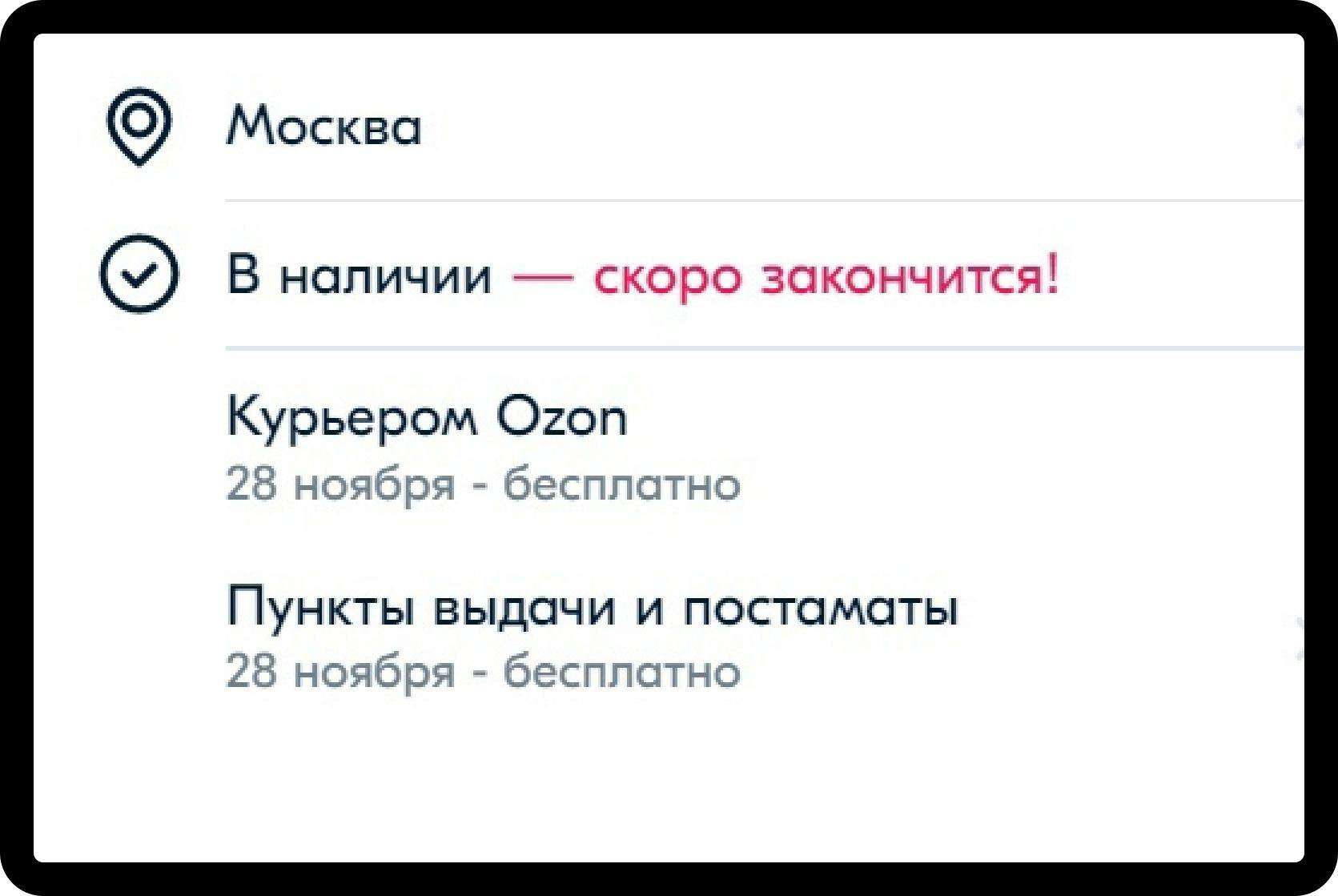

2. География и язык. Если сайт работает в нескольких регионах или странах, стоит добавить переключатель языков и создать поддомены, например, site.msk.ru или site.spb.ru. Это поможет привлечь целевой трафик и улучшить ранжирование в поиске. Если есть офисы в разных городах, указывайте контакты отдела из города лида, а не только адрес столичного офиса. 3. Адаптивность. Пользователи заходят на сайты с мобильных устройств всё чаще. По данным исследования медиапотребления в России 2020 году от компании Deloitte, 92% россиян выходят в интернет через смартфоны. Проверьте, как выглядит сайт на смартфонах и планшетах: не съехала ли вёрстка, не потерялись ли важные элементы и СТА, учтено ли удобство для пользователя мобильного устройства. Например, в версии для смартфонов можно расположить кнопку обратного звонка справа снизу, а не в меню вверху экрана — чтобы пользователю было удобно нажать на неё большим пальцем. 4. Фавикон и сниппет. Фавикон — маленький логотип, который выделяет сайт в поисковой выдаче. По нему проще найти вкладку с ресурсом в браузере. Настройте сниппет — это блок с описанием сайта в поисковой выдаче. Укажите важные разделы, чтобы пользователь сразу переходил, куда ему интересно. 5. Страница 404. Эта страница об ошибке — пользователю говорят, что запрашиваемая страница не найдена. Добавьте на неё строку поиска и ссылки, которые ведут на главную страницу, разделы сайта и контакты. 1. Восприятие цвета. Учитывайте пользовательский опыт, чтобы улучшать юзабилити сайта. Если человек привык, что красный означает ошибку, серый — неактивное поле, а зелёный — что он правильно заполнил форму, не нужно использовать другие цвета. Вы только запутаете пользователя. 2. Без нагромождения. Гигантские блоки с картинками, текстом и видео перегружают дизайн. Нужно приложить усилие, чтобы во всём разобраться. Это плохо — контент нужно структурировать. 3. Кликабельные элементы. Выделяйте всё, на что посетитель может нажать. Пользователь должен отличать кнопки, баннеры и ссылки от остальных блоков. 4. Паттерны сканирования. Пользователи привыкли «читать» сайты слева направо или по модели F — когда взгляд скользит по странице как по контурам этой буквы. Кнопки, СТА, заголовки, поиск располагайте удобно для быстрого чтения. 1. Однозначный СТА. Кнопка должна побуждать пользователя к действию — купить, заказать, добавить в корзину. Используйте инфинитивы и чёткие, однозначные формулировки. 2. Оформление ссылок. Подчёркивайте ссылки и выделяйте синим. Настройте курсор, чтобы при наведении на кликабельный элемент он менялся на иконку-курсор в виде руки. 3. Поиск и «хлебные крошки». Поместите поиск на видное место в верхней части страницы. Не забудьте про «хлебные крошки» — это путь по разделам до конкретного товара. Он поможет вернуться в любой раздел. 4. Информация в текстах. Всю важную информацию публикуйте текстом, а на не картинках. Возможно, пользователь захочет скопировать адрес, телефон или название товара, чтобы поискать в браузере отзывы или отправить знакомым в мессенджере. Дайте ему такую возможность. Не используйте на сайте защиту текста от копирования. 5. Подробные контакты. Указывайте адрес, телефон, время работы, соцсети — всё, что поможет пользователю связаться с вами. Если офисов несколько, расположите их на карте, чтобы было легко найти ближайший. Добавьте фильтры поиска — по адресу, по метро. 6. Регистрация. Сделайте простые и понятные поля формы регистрации, покажите в плейсхолдерах, как их заполнять. Упростите процесс: добавьте регистрацию в один клик или через соцсети и сервисы. 7. Онлайн-консультант. Добавьте чат-бота, который ответит на типовые вопросы пользователя. Для нетиповых вопросов добавьте возможность перевода обращения на оператора, укажите время ожидания. Иконка онлайн-консультанта должны быть заметной. Плохо, когда она пульсирует или перемещается по странице — это может отвлекать и даже раздражать пользователя. 8. Форма обратной связи. Если консультанты не могут ответить, когда пользователь находится на сайте, например, в ночное время, предложите посетителю оставить контакты для связи. У Roistat есть инструмент Ловец Лидов — с его помощью можно собрать контакты тех, кто хочет покинуть сайт, и тех, кто долго находится на одной странице. Рассказали в блоге: как получать больше заявок с помощью Ловца Лидов. 1. Страница товара. У товаров должно быть чёткое, подробное название, заметная цена и подробное описание: Добавляйте инструкции к продуктам, указывайте количество отзывов и среднюю оценку. 2. Фильтры. Иногда пользователь знает, по каким характеристикам искать товар. Помогите ему, добавив фильтры. Например, он ищет ноутбук — укажите в фильтрах диапазон цен, размер оперативной памяти, видеокарту, тип процессора и другие параметры. 3. Популярные товары. Пользователи могут и сами сортировать результаты поиска, например, по стоимости и оценке покупателей. Но по умолчанию поставьте сортировку по популярности — это поможет посетителю выбрать то, что покупает большинство. 4. Корзина. Настройте анимацию, когда пользователь добавляет товар в корзину — изменится кнопка, подпрыгнет значок с корзиной, рядом с ним появится цифра (по числу товаров в корзине). Добавление в корзину означает, что лид почти решился на покупку. Не отвлекайте его предложениями, каталогами, рекламой. В корзине он должен увидеть выбранный товар и кнопку, чтобы сделать заказ. 5. Оплата. С ней нужно быть осторожным — клиенты напрягаются из-за неоднозначных формулировок. Укажите только самое главное: способ и время оплаты (например, при получении или онлайн), добавьте кнопку «Оплатить». Сообщите, что заказ оформлен, оплата прошла успешно. Если произойдёт ошибка, расскажите, что нужно делать — добавьте телефон для звонков или иконку онлайн-консультанта. 6. Доставка. Ещё одна страница с минимумом полей. Добавьте ввод адреса по местоположению пользователя. Если пользователь заполнил форму доставки один раз, настройте автозаполнение для следующих заказов. Оценка юзабилити — достаточно трудоёмкий процесс. Нужно понять слабые места сайта, собрать данные об эффективности — какая конверсия в заявки и какая в продажи, отследить, как пользователи взаимодействуют с сайтом, а также узнать, как делают сайты конкуренты. Чтобы продажи росли, а клиенты не уходили, нужно быть мощнее конкурентов и учитывать потребности аудитории. Если у вас нельзя оформить покупку в один клик, а на другом сайте давно стоит Apple Pay, ваша конверсия в покупку наверняка ниже, чем у конкурентов. Веб-аналитики Roistat упростят процесс проверки юзабилити сайта и заберут аудит на себя. Не нужно регистрироваться в различных сервисах, покупать подписки, выгружать данные и собирать их в единый отчёт. Специалисты проведут анализ юзабилити сайта по всем сервисам, соберут отчёт по ошибкам, подскажут, как их исправить. Заказать услугу аудита юзабилити сайта Заказать Чек-лист юзабилити сайта у специалистов Roistat в рамках аудита: Рассказали в блоге: как услуга юзабилити-аудита от Roistat поможет сделать сайт удобным для посетителей. На нашем Telegram-канале делимся полезными материалами по маркетингу и аналитике, кейсами клиентов, собираем познавательные дайджесты и анонсируем бесплатные обучающие вебинары. Подписывайтесь, чтобы ничего не пропустить!Изменения дизайна для юзабилити

Навигация и интерфейс для юзабилити сайта

Оптимизация работы с товаром для юзабилити сайта

Итоговые рекомендации по проверке юзабилити сайта

Технический аудит сайта — это комплекс работ, позволяющий выявить ошибки и проблемы, влияющие на индексацию и ранжирование в поисковых системах. Результатом анализа сайта является техническое задание (отчет) с описанием всех найденных ошибок и рекомендациями по их исправлению.

Ошибки на сайте могут привести к ухудшению ранжирования и полному исключению сайта из результатов поиска, а также влиять на качество и скорость индексирования страниц сайта.

Сегодня я полностью разберу, что такое технический аудит, кем и как он проводится и для чего необходим. Я рассмотрю все на примерах и приведу чек-лист работ. Если вдруг останутся вопросы или что-то будет непонятно, обязательно задавайте свои вопросы в комментариях!

Цель аудита: анализ технических параметров сайта для выявления и исправления всех ошибок.

Периодичность: данные работы обязательно проводятся при старте SEO-продвижения, а также в ходе дальнейшей жизни проекта. Связано это с тем, что любой хороший сайт дорабатывается и обновляется. Таким образом, существует вероятность, что на ресурсе появятся новые ошибки, которые лучше исправить сразу, чем они успеют негативно сказаться на ранжировании сайта.

А нужно ли это мне? Данные работы можно не проводить, если только невозможно исправить на Вашем сайте найденные ошибки.

Технические ошибки на сайте влияют на индексацию и ранжирование. Чек-лист помогает лишь выявить большинство проблем, но иногда приходится сталкиваться с ошибками, которые стандартными способами не выявить. Такое случается редко, но SEO-специалист должен индивидуально подходить к каждому ресурсу.

Подготовительные работы

При проведении полного технического аудита нам понадобится доступ в сервисы:

- Яндекс.Вебмастер [webmaster.yandex.ru] — разберем детально ниже;

- Search Console от Google [www.google.com/webmasters/] — разберем детально ниже;

- Яндекс.Метрика. Тут нам интересны для технического аудита данные о времени загрузки страниц. Информация находится в разделе «Отчеты» — «Стандартные отчеты» — «Мониторинг» — «Время загрузки страниц». Если заметили аномалию — необходимо разбираться. При желании можно пользоваться Google Analytics.

Сервисы являются бесплатными и позволяют получить первичную полезную информацию. Если еще не добавились, самое время сделать это.

Чек-лист технического аудита сайта

Ниже перечень всех ошибок, которые нужно проверить. Если Вам нужен именно excel-файл с чек-листом — подпишитесь на рассылку и напишите мне на почту info@albakoff.ru. Поделюсь бесплатно!

Проверка сайта в Яндекс.Вебмастер

У нового Яндекс.Вебмастера появилось много возможностей для оптимизатора. Поэтому необходимо проверить:

- проблемы сайта в разделе «Диагностика сайта».

Важно, чтобы у сайта не было «фатальных» и «критичных» ошибок. Желательно исправить и «возможные проблемы», но их существование не так критично.

- нарушения сайта в разделе «Диагностика»- «Безопасность и нарушения».

В данном разделе показаны ошибки, которые представляют угрозу для посетителей (например, из-за вирусов, загрузки нежелательного ПО и т.д.) или для естественного ранжирования (например, из-за использования SEO-ссылок).

- выбор главного зеркала в разделе «Индексирование» — «Переезд сайта».

Страницы сайта с www и без него (например, www.albakoff.ru и albakoff.ru) — это не одно и то же для робота поисковых систем. Чаще всего они являются дублями. Аналогично и с http/https. Необходимо выбрать главное зеркало и указать его.

- присвоение региона в разделе «Информация о сайте» — «Региональность».

Проверьте, правильно ли присвоен регион сайту. Поисковые системы учитывают регион при ранжировании сайтов, если это необходимо. Например, если я хочу заказать «строительство дома» и буду искать подходящую компанию, то мне интересны только местные организации, где я смогу посетить офис и обсудить все детали.

Но если я буду искать «биографию Пушкина», то мне и поисковым системам не важен регион сайтов. Кроме Яндекс.Вебмастера, регион желательно присвоить в Яндекс.Справочнике. Подробнее в статье про региональное продвижение сайтов.

Данный инструмент позволяет исправить лишь часть ошибок на сайте. Кроме этого, он не всегда отображает наложенные санкции. Если есть подозрения на санкции, напишите письмо в техподдержку Яндекса.

Проверка сайта в Search Console от Google

Находится по адресу: www.google.com/webmasters/. Тут нам необходимо проверить:

- информацию в разделе «Сообщения».

Тут Вы найдете уведомления о резком росте ошибок на сайте, недоступности и т.д.

- меры по борьбе с веб-спамом в разделе «Поисковый трафик» – «Меры, принятые вручную».

- наличие ошибок при обходе сайта в разделе: «Сканирование» – «Ошибки сканирования» + «Проблемы безопасности».

Тут Вы найдете, например, информация о 404-ых ошибках (битых ссылках) на сайте, известных роботу. Поставьте правильную ссылку, либо удалите ее с документа.

- проблемы с содержанием Вашего сайта в разделе «Вид в поиске» – «Оптимизация HTML».

Тут отображаются ошибки, связанные с тегами заголовка и метаописания:

- кроме проверок, необходимо указать основной домен сайта в разделе «Настройки сайта».

Основные параметры

- Страницы сайта должны иметь постоянный URL-адрес. Разберем на примере частой ошибки: у интернет-магазина присутствует множество категорий. Товар может находиться в любой из них. URL формируется в зависимости от того, через какой раздел мы попадаем в карточку товара. Таким образом создаются дубли: у одной карточки товара несколько URL-адресов в зависимости от категории;

- Каждая страница, которая доступна для индексации, должна иметь уникальный Title;

- На сайте желательно использовать ЧПУ с вхождением ключевых слов;

- У сайта должен быть привлекательный фавикон!

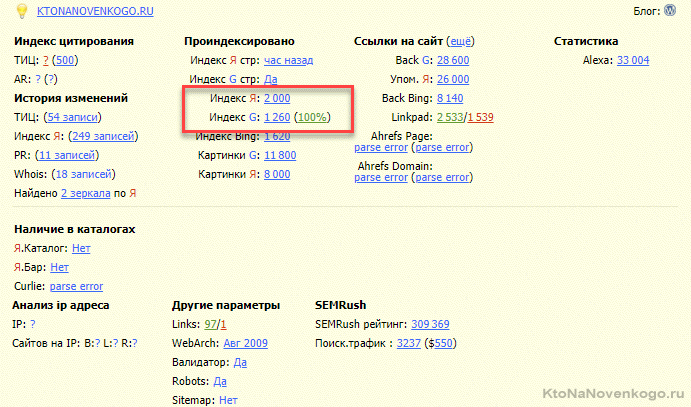

Проверка индексации сайта

Индексация — это процесс обхода сайта роботами поисковых систем и включения в базу поисковой системы. Для продвижения важны полнота и качество индексации сайта. Дубли, мусорные и служебные страницы не должны попадать в базу. Но посадочные (продвигаемые) страницы обязательно должны быть в индексе. Количество страниц в индексе можно посмотреть в вебмастере или при помощи операторов:

Сравнивать число страниц, находящихся в индексе, с числом посадочных страниц для продвижения — неправильно, т.к. вместо посадочных, может быть такое же количество мусорных страниц. Но кол-во страниц в Яндексе и Google должно быть примерно одинаковым (только если под одну из ПС Вы не делаете дополнительных посадочных страниц), после детальной проработки следующих пунктов:

- Настройка главного зеркала.

Кроме указания в вебмастере Яндекса и Google, необходимо дополнительно указать главное зеркало сайта в файле robots.txt и настроить 301 редирект со всех страниц неосновного зеркала на основное.

Например, для данного сайта главным зеркалом является: https://albakoff.ru/. Соответствующая запись об этом есть в файле robots.txt:

Важно: если Вы продвигаете сайт с https, то главное зеркало у Вас с https. В поле host необходимо указать домен с протоколом: https://albakoff.ru/.

Кроме этого, должен быть настроен 301 редирект со всех страниц неосновного зеркала.

Если Вы перейдете со страницы c www: http://www.albakoff.ru/poiskovye-zaprosy-klassifikatsiya-tipy-vidy/, то произойдет перенаправление на соответствующую страницу без www: https://albakoff.ru/poiskovye-zaprosy-klassifikatsiya-tipy-vidy/.

- Посадочные страницы открыты для индексирования. Необходимо проверить файл robots.txt, мета тег robots и указание канонической страницы.

- Мусорные страницы должны быть закрыты от индексирования:

- Дубли — документы, которые полностью или частично дублируют другие документы;

- Результаты поиска на сайте;

- Страницы фильтров, печати, сортировок и т.д., если они не являются посадочными;

- Служебные страницы: корзина сайта, кабинет пользователя, профили, страница регистрации и т.п.;

- Коды скриптов CSS, javascript, картинки открыты для индексирования;

Проверка кода страниц сайта

- Правильное использование <noindex> на сайте (полезный контент сайта не закрыт от индексирования);

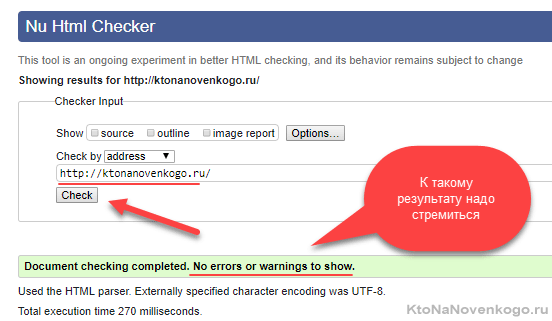

- Чистый код сайта — валидация без ошибок (validator.w3.org), отсутствие больших кусков кода javascript и стилей в html;

- Пользователи и роботы видят одинаковый контент сайта;

- Правильное использование заголовков h1-h6. Хотя это и не является обязательным сегодня, но рекомендую правильно строить структуру документа. А именно: наличие одного (и только одного!) заголовка h1 на странице, а также соблюдение иерархии и последовательности следующих заголовков;

- Номера телефона, адреса, пункты в меню и другой контент написан текстом, а не вставлен картинкой;

- Выделение слов жирным или курсивом придает им больший вес, но не нужно выделять ключевые слова данным способом;

- Для картинок заполнен атрибут alt (описание должно содержать информацию о содержимом картинки). Атрибут title можно не использовать для картинок и ссылок.

Проверка ответа сервера, наличие редиректов, битых и внешних ссылок

- Ответ сервера «200 ОК» должны отдавать все страницы, доступные для пользователя;

- Отсутствие редиректов внутри сайта. Для этого нужно получить список всех страниц сайта с кодом ответа сервера 30х (например: 301, 302 …). На страницах, где данные ссылки размещены — необходимо либо полностью убрать ссылки, либо поставить правильные ссылки без редиректов. Для получения списка страниц можно использовать NetPeak Spider или Screaming Frog Seo Spider;

- Отсутствие битых ссылок на сайте. Проверяем аналогично редиректам, только ищем страницы с кодом ответа сервера 40х (например: 404, 403 …);

- Использование внешних ссылок сведено к минимуму для сохранения веса страниц;

Проверка 404 страницы

Все несуществующие страницы должны отдавать код ответа сервера «ошибка 404», если с них не настроен 301 редирект на новую страницу. Требования к данной странице:

- пользователь должен понимать, что находится на странице с несуществующей страницей и по какой причине;

- у пользователя должно быть решение проблемы, например: форма поиска или другие полезные страницы.

Пример страницы:

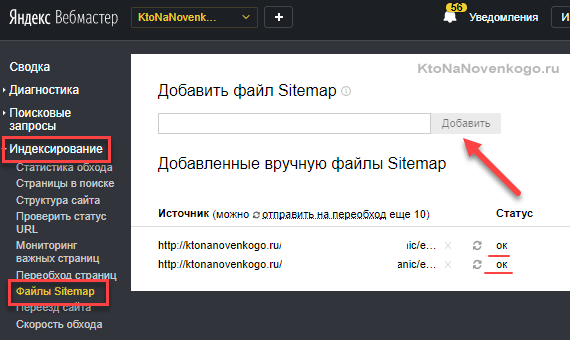

Наличие карты сайта

- Карта сайта sitemap.xml — обновляемый файл, указанный в robots.txt и отдельно загруженный в Яндекс- и Google-вебмастер;

- Карта сайта в формате html, если существуют страницы сайта с уровнем вложенности больше 3-его;

Удобство для пользователя

- Быстрый ответ сервера и скорость загрузки страниц сайта;

- Правильное отображение сайта в различных браузерах;

- Адаптация сайта под мобильные устройства;

- Текст на сайте является уникальным, а контент удобно читать и воспринимать. На сайте нет сплошного текста без подзаголовков и картинок. Размер шрифта не должен быть слишком маленьким или большим. При необходимости используются списки;

- Использование ЧПУ и нормальной структуры сайта.

Если сайт не индексируется, а я все исправил?

Если вдруг у Вас проблемы с индексацией сайта, то план действий следующий:

- напишите в тех. поддержку Яндекса. Иногда бывает, что ошибка на стороне поисковика.

- перепроверьте полностью сайт на наличие ошибок. Возможно, у Вас генерируется огромное количество дублирующих страниц, на сайте неуникальный контент или еще что-то.

- поработайте над структурой сайта, меню и перелинковкой. Желательно, чтобы все страницы были 2-3 уровня вложенности.

- добавьте только непроиндексированные страницы в sitemap.xml.

- еще раз проверьте файл robots.txt, мета-тег robots и указание канонической страниц.

А также может быть, у Вас домен с плохой историей. Проверьте ее в вебархиве и по упоминаниям в поиске.

Оформление технического аудита

После проведения аудита, необходимо составить отчет, который должен содержать:

- техническое задание для программиста — это список ошибок и проблем на сайте, которые нужно устранить. ТЗ должно содержать точное указание того, что необходимо сделать программисту;

- отчет для клиента — список всех проверенных по чек-листу пунктов, словарь терминов и т.д.;

Желательно сопровождать рекомендации примерами (как сделано сейчас и как должно быть), скриншотами, таблицами, которые будут доказывать необходимость внедрения рекомендаций. Оптимального объема для технического аудита не существует и он зависит от количества ошибок на сайте.

После внесения всех правок на сайт, желательно еще раз перепроверить корректность работы программиста. Частая ошибка: появление новых ошибок после исправления старых (и тут дело не только в исполнителе, но в системе управления сайтом).

Техническая составляющая сайта важна при поисковом продвижении, так как технические ошибки влияют на конверсии, поведение пользователей и на ранжирование сайта в поисковых системах. Чтобы устранить технические ошибки необходимо провести подробный анализ сайта и сформировать технические задания для устранения проблем.

Что такое технический аудит

Технический аудит – это комплексная проверка всех значимых модулей, элементов и параметров сайта, которые обеспечивают эффективность работы сайта. Это один из основных этапов поискового продвижения сайта. Наличие технических проблем может напрямую влиять на ранжирование сайта. Решение технических проблем может значительно улучшить положение сайта в поисковых системах, что приведет к росту поискового трафика и конверсий.

Более того работоспособность сайта важна не только при SEO-продвижении, но и в целом. Например, медленная скорость загрузки страниц или отсутствие адаптивности сайта к мобильным устройствам может негативно сказать на прямом и рекламном трафике и на количестве постоянных пользователей.

Для чего проводить технический аудит сайта

Технический аудит необходимо проводить для того, чтобы выявить проблемы и ошибки, которые негативно влияют на ранжирование сайта и затрудняют взаимодействие с ним.

Технический анализ позволяет проверить доступность всего контента для поисковых роботов, проверить наличие важных тегов и заголовков, выявить проблемы, которые затрудняют взаимодействие пользователей с сайтом, а также выявить другие ошибки, которые затрудняют продвижение сайта.

Кому и когда нужен технический аудит

- Новому сайту перед релизом. Это позволит устранить технические ошибки перед запуском и обеспечить быструю индексацию страниц сайта и контента. Технический анализ на начальном этапе позволит заложить прочный фундамент и сконцентрироваться на решении других SEO-задач;

- Сайтам, у которых техническая проверка не проводилась более 6 месяцев. Даже если над сайтом не ведутся работы, могут возникать технические ошибки, в особенности на больших проектах. В связи с этим как минимум раз в 6 месяцев необходимо проводить технический анализ сайта;

- При резком снижении поискового трафика или видимости и позиций сайта в поисковых системах. Если нет явной причины снижения трафика и видимости, проблема может быть связана с наличием технических ошибок;

- При переезде сайта на другую CMS систему. В данном случае необходимо провести техническую проверку, как до переезда, так и после. Это позволит устранить все ошибки до переезда на другую CMS и проверить, не возникло ли ошибок при переезде;

- Трафик с поиска идет, но нет конверсий. Отсутствие конверсий может быть также связано с наличием технических проблем.

Даже если у вас нет проблем и сайт хорошо ранжируется, рекомендуем регулярно проводить техническую проверку. Так вы сможете получить информацию об изменении алгоритмов ранжирования поисковых систем, а также получить рекомендации по улучшению сайта в соответствии с новыми трендами SEO.

Формат технического аудита

Наиболее оптимальным форматом технического аудита будет формат таблицы со следующим содержанием:

- Пункт проверки

- Статус (обнаружены или не обнаружены проблемы)

- Ход проверки (тезисно описать, как проводилась проверка)

- Результат проверки

- Рекомендация (техническое задание на исправление ошибки)

- Приоритет (на сколько сильно влияет проблема на ранжирование сайта)

- Результат (к чему приведет решение проблемы)

Чек-лист технического аудита сайта

Данный чек-лист позволит провести подробную проверку вашего сайта и выявить ошибки, которые мешают ранжированию сайта в поисковых системах. В ходе проверки сайта необходимо зафиксировать все найденные проблемы и сформировать технические задания для устранения ошибок.

Проверка файла robots.txt

Необходимо проверить наличие и корректность составления файла robots.txt.

Robots.txt – это файл, который разрешает или запрещает поисковым системам индексировать страницы сайта. Этот файл позволяет закрыть от поисковых системы дубли страниц (например, страницы сортировки или страницы с utm-метками), закрыть служебные или мусорные страницы.

Данный файл размещается на сервере по адресу https://site.ru/robots.txt. Он не является обязательным, но в ряде случаев может значительно повлиять на ранжирование сайта.

Подробнее о том, как составить файл robots.txt вы можете прочитать в нашей статье.

Пример содержимого файла robots.txt:

User-agent: *

Allow: /bitrix/*.png

Allow: /bitrix/*.jpg

Allow: /bitrix/*.jpeg

Allow: /bitrix/*.pdf

Disallow: /bitrix/

Disallow: /*sort=

Disallow: /*search=

Disallow: /*utm_

Disallow: /*cm_id

Disallow: /*yclid

Disallow: /*gclid

Disallow: /*_openstat

Sitemap: https://site.ru/sitemap.xml

Проверка xml-карты сайта Sitemap.xml

Необходимо проверить наличие и корректность составления xml-карты сайта.

Карта сайта Sitemap.xml может улучшить индексацию сайта. В данном файле должны содержаться ссылки на все продвигаемые страницы сайта.

Описание формата сайта можно найти по ссылке.

В карте сайта должны присутствовать только ссылки на существующие канонические страницы с 200 кодом ответа. Не следует включать в карту сайта страницы с GET-параметрами и страницы пагинации.

В карте сайта необходимо разместить ссылку на страницу и дату последнего обновления.

Рекомендуем реализовать автоматическую генерацию карты сайта (чтобы при добавлении на сайт новых страниц они добавлялись в карту сайта). Также рекомендуем автоматически обновлять карту сайта раз в неделю.

Пример формата и оформления xml-карты сайта представлен ниже:

<?xml version=»1.0″ encoding=»UTF-8″?>

<urlset xmlns=»http://www.sitemaps.org/schemas/sitemap/0.9″>

<url>

<loc>https://site.ru/</loc>

<lastmod>2022-08-01</lastmod>

</url>

<url>

<loc>https://site.ru/page/</loc>

<lastmod>2022-08-01</lastmod>

</url>

</urlset>

Проверка индексации сайта в Яндекс Вебмастере

Индексация страницы – один из первых шагов в SEO-продвижении.

Для того, чтобы страницы сайта ранжировались в поисковых системах, они должны попасть в индекс Яндекса и Google.

В индекс должны попасть все информативные страницы сайта. Кроме того, в индекс должен попасть весь контент, который представлен на данных страницах.

От полноты индексации зависит положение сайта в поисковых системах.

В связи с этим необходимо уделить индексации сайта особое внимание и убедиться, что все необходимые страницы попали в индекс.

С помощью Яндекс Вебмастера можно проверить, какие страницы попадают или исключаются из индекса.

Необходимо убедиться, что все нужные страницы находятся в индексе и отдают 200 код ответа сервера, а ненужные (например, служебные страницы, страницы с 301 или 404 кодом ответа, страницы, закрытые в robots.txt и неканонические страницы) исключаются из индекса.

Необходимо зайти в раздел «Индексирование» – «Страницы в поиске». В данном отчете будут отражены страницы, которые попали в индекс или были исключены из индекса, а также статус страницы (например, неканоническая) и причина попадания или исключения из индекса.

Проверка индексации сайта в Google Search Console

Через Google Search Console можно проверить, как индексируется сайт в Google.

В ряде случаев страницы могут быть просканированы поисковыми роботами, но не проиндексированы. В таком случае необходимо выявить причину, почему страницы не проиндексированы и устранить проблему.

Все информативные страницы сайта должны быть просканированы и проиндексированы Google.

Проверка наличия служебных страниц и поддоменов в индексе

Наличие служебных страниц и поддоменов в индексе может негативно сказать на ранжировании сайта.

Наличие таких страниц в индексе можно проверить через Google Search Console и Яндекс Вебмастер.

При наличии служебных поддоменов необходимо проверить, закрыты ли поддомены обязательной авторизацией или файлом robots.txt.

Анализ тегов noindex и nofollow

Некоторые страницы, ссылки или определенные элементы страницы могут быть закрыты от индексации и сканирования тегами noindex и nofollow.

При наличии данных тегов на сайте необходимо проверить, не закрыты ли от индексации важные для продвижения страницы или контент.

Проверка наличия и корректности заполнения тега Canonical

На всех страницах сайта желательно указывать тег Canonical, указывающий основной адрес страницы без GET-параметров. Данный тег следует разместить в коде сайта в раздел <head></head>..

Canonical является рекомендацией для поисковой системы Яндекс и не является обязательным. При этом в некоторых случаях указание основной страницы может положительно повлиять на индексацию и избежать появление дублей страниц.

При размещении тега необходимо соблюсти последовательность атрибутов:

<link rel=»canonical» href=»https://site.ru/catalog/»>

Проверка сайта на аффилированность

Наличие у одной компании двух или более сайтов одной тематики может стать причиной наложения фильтра Аффилиат в Яндексе. После чего в поисковой выдаче по каждому конкретному запросу сможет присутствовать только один из сайтов компании.

Меры, которые следует предпринять во избежание попадания под фильтр:

1. Закрыть все второстепенные сайты и настроить 301 редирект на соответствующие разделы основного сайта компании (при этом необходимо будет поддерживать этот 301 редирект и сохранять регистрацию доменов за компанией). Тем самым объединить все ресурсы в один и сконцентрироваться на его продвижении.

2. Закрыть все второстепенные сайты от индексации через файл robots.txt.

Это самое простое решение, и поможет минимизировать вероятность помех дочерних сайтов при продвижении основного ресурса. Однако данный способ не гарантирует того, что Яндекс будет показывать в выдаче только основной домен. Например, по брендовым запросам, Яндекс может отдавать предпочтение второстепенным ресурсам.

Чтобы обеспечить показы в выдаче лишь вашего основного сайта необходимо на всех дочерних проектах настроить ответ сервера 404 для всех роботов Яндекса (подробнее по ссылке – https://yandex.ru/support/webmaster/robot-workings/check-yandex-robots.html). В этом случае можно гарантировать, что дочерние сайты не будут показываться в выдаче вместо основного.

Проверка кодов ответа сервера

Все существующие и продвигаемые страницы сайта должны отдавать 200 код ответа сервера. Также все ссылки, размещенные на сайте, должны отдавать 200 код ответа сервера. Кроме того, страница должна быть доступна только по одному адресу.

В каких случаях страница может быть доступна по нескольким адресам:

https://site.ru/ – главное зеркало

http://site.ru/ – страница с http протоколом

https://www.site.ru/ – страница с www

http://www.site.ru/ – страницы с www и http протоколом

https://site.ru – страница без / в конце

Если все 5 страниц отдают 200 код ответа, они являются дублями и могут попасть в индекс поисковых систем. Наличие дублей может негативно сказаться на ранжировании сайта.

В связи с этим для всех типов страниц необходимо настроить серверные 301 редиректы со страницы с http на https, с www на без www, со страницы без / в конце на страницу со / в конце. Чаще всего такие редиректы настраиваются в файле .htaccess на сервере.

Для всех несуществующих страниц необходимо настроить 404 код ответа сервера и при переходе на такие страницы необходимо выводить страницу 404 ошибки.

Проверка наличия и оформления страницы 404 ошибки

При попадании на несуществующие страницы необходимо выводить страницу 404 ошибки.

Рекомендуем оформить страницу с 404 ошибкой следующим образом:

1. Название: “Страница 404”

2. Изображение

3. Текст: “К сожалению, запрашиваемой вами страницы не существует на сайте. Возможно, страница была удалена или адрес страницы виден с ошибкой. Вы можете перейти на главную страницу [ссылка] или воспользоваться поиском [ссылка]. Получите скидку 3% на заказ нашем сайте по коду — [промо-код]”.

4. Блок с популярными товарами или категориями.

Мета-тег title для страницы 404 ошибки рекомендуем сформировать следующим образом:

“Страница не найдена – Ошибка 404”.

Поиск битых ссылок

Все страницы сайта должны быть наполнены контентом и отдавать 200 код ответа.

На сайте не должно быть битых ссылок (ссылок на несуществующие страницы с 404 кодом ответа сервера).

Такие ссылки могут появляться в случае, если адрес страницы был изменен или введен с ошибкой, либо страница была удалена, но ссылка осталась на сайте.

Необходимо проверить сайт на наличие битых ссылок и при обнаружении удалить данные ссылки, либо заменить на существующие страницы. Часто такие ссылки могут содержаться в сквозных блоках, например в подвале сайта или в главном меню.

Для поиска ссылок можно использовать софт для ПК Screaming Frog.

Подробнее о том, как провести технические анализ в Screaming Frog, вы можете прочитать в статье.

Поиск ссылок с 301 редиректом

Все внутренние ссылки на сайте должны быть размещены с 200 кодом ответа.

Необходимо проверять сайт на наличие ссылок с 301 редиректом и при наличии таких ссылок необходимо заменить их на ссылки с 200 кодом ответа сервера.

Найти ссылки с 301 редиректом можно с помощью софта Screaming Frog.

Подробнее о том, как провести технические анализ в Screaming Frog, вы можете прочитать в статье.

Поиск пустых страниц

На сайте не должно быть пустых страниц. Наличие большого количества пустых страниц может негативно сказаться на ранжировании сайта. Так как пустые страницы бесполезны для пользователей, они снижают релевантность и полезность сайта, а также могут привести к росту числа отказов.

Пустые страницы можно найти через программу Screaming Frog.

Подробнее о том, как провести технические анализ в Screaming Frog, вы можете прочитать в статье.

Проверка корректности формирования URL адресов

При формировании URL адресов на сайте необходимо придерживаться следующих правил:

- Создавать ЧПУ (человекопонятные URL) адреса

- Включать в URL основные ключевые слова (можно дублировать содержание заголовка h1)

- При формировании URL использовать транслитерацию

- Использовать только символы нижнего регистра

- В качестве разделителя использовать только тире –

- Закрывать все URL адреса / в конце

- Указывать путь к странице в URL в соответствии с иерархией и уровнем вложенности страницы

- Не использовать GET-параметры для канонических страниц

- Если URL получается длинным, старайтесь сокращать адрес страницы

Проверка наличия дублей страниц

Ряд страниц могут иметь разные мета-теги и заголовки, при этом текст и содержание страниц может дублироваться.

Наличие таких страниц может негативно сказаться на ранжировании сайта, в связи с чем рекомендуем избавлять от дублей страниц.

При обнаружении таких страниц необходимо скорректировать контент и переписать тексты, если они дублируют друг друга.

Подробнее о том, как провести технические анализ в Screaming Frog, вы можете прочитать в статье.

Проверка дублирования контента

На разных страницах сайта может быть размещен дублирующийся контент.

Это может негативно сказаться на ранжировании сайта, так как поисковым система будет сложнее определить, какая страница наиболее релевантна поисковым запросам.

Необходимо размещать на всех страницах сайта уникальный контент. Исключением могут быть сквозные блоки, элементы для перелинковки, типовые блоки (например, преимущества, гарантии, доставка и т.д.).

Проверка уникальности контента

Контент должен быть уникальным не только внутри сайта, но и в целом.

Необходимо проверить тексты на уникальность, чтобы они не дублировали содержание страниц с других сайтов. Неуникальный контент может негативно сказаться на ранжировании сайта.

Проверка корректности заполнения тега title

Тег title – это заголовок страницы, который отображается в поисковой выдаче.

Title должен быть уникальным. В случае, когда тег title дублируется, такие страницы могут восприниматься поисковыми системами как дубли. Соответственно это может негативно сказаться на ранжировании, так как поисковым системам сложнее определить, какая страница должна ранжироваться по соответствующим поисковым запросам.

Подробнее о том, как правильно составить тег title читайте в статье.

Проверка корректности составления мета-тега description

Мета-тег description не оказывает прямого влияния на ранжирование сайта.

При этом description формирует сниппет в поисковых системах и может повлиять на CTR. Необходимо проверить корректность заполнения тега на всех страницах сайта.

В мета-тегах description не должно быть спама, лишних спецсимволов.

Яндекс рекомендует заполнять мета-тег description на всех страницах сайта.

Проверка корректности составления заголовков h1

На каждой странице сайта должен быть размещен основной заголовок в тегах

<h1></h1>. При этом данным тегом должен быть размечен только один заголовок на странице. Основной заголовок должен передавать содержание страницы.

Необходимо проверить наличие данного заголовка на всех страницах сайта, а также проверить, нет ли страниц, где тегом <h1> размечено несколько заголовков.

Также необходимо проверить, нет ли большого количества дублей заголовков h1. Желательно уникализировать заголовки, чтобы они отражали основное содержание страницы.

Проверить корректность формирования заголовков h1 можно с помощью софта Screaming Frog.

Анализ структуры подзаголовков h2-h6

Для разметки заголовков на страницах сайта рекомендуем использовать теги <h2> и <h3>.

Данные заголовки должны отражать структуру и содержание страницы. Правильно структурированные данные позволят повысить релевантность страницы, что может положительно сказаться на ранжировании сайта.

Тегом <h2> рекомендуем обозначать важные элементы, например в карточках товаров “Описание товара”, “Характеристики”, “Отзывы”.

Тегом <h3> рекомендуем обозначать менее важные блоки, например “Похожие товары”, “С этим товаром покупают”. Подзаголовки, которые находятся внутри блоков, рекомендуется оформлять текстом и выделять жирным шрифтом.

В статьях рекомендуется использовать заголовки <h2> для обозначения основных разделов статьи, а заголовками <h3> обозначать подразделы. Внутри подразделов заголовки рекомендуем оформлять в виде текста и выделять их жирным шрифтом.

Анализ страниц пагинации

Страницы пагинации должны быть доступны для индексации. В связи с этим необходимо убедиться, что в html-коде сайта присутствуют ссылки на все страницы пагинации.

Также во избежание возникновения дублей страницы рекомендуем провести следующие работы.

1. На страницах пагинации рекомендуем разместить тег Canonical в разделе <head></head>, указывающий адрес страницы пагинации.

Пример:

<link rel=»canonical» href=»https://www.site/category/page-2/»>

2. На страницах пагинации необходимо уникализировать тег title. во избежание дублей страниц.

Пример шаблона:

[title] – Страница [номер страницы] Купить кроссовки в интернет-магазине – Страница 2

3. Для первых страниц пагинации рекомендуем настроить 301 редирект на основные страницы без GET-параметров.

Например, со страницы https://www.site/catalog/page-1/ на https://www.site/catalog/

При этом в html-коде необходимо разместить ссылку на основную каноническую страницу с 200 кодом ответа.

4. Также рекомендуем деоптимизировать страницы пагинации, чтобы не снижать релевантность основной страницы:

- Сократить title, например, продублировав заголовок h1;

- Удалить SEO-текст или описание категории (если текст присутствует на странице).

Проверка адаптивности сайта

Сайт должен корректно отображаться как с ПК, так и с мобильных устройств. Кроме того, в мобильной и адаптивной версии сайта должны присутствовать все ссылки, кнопки, тексты и прочие элементы, которые есть в версии для ПК.

Мобильная и адаптивная версия должны быть удобными с точки зрения юзабилити, быстро работать, не быть перегруженными.

Наличие адаптивной или мобильной версии сайта – важный фактор ранжирования. Анализу мобильной версии стоит уделить особое внимание.

Анализ скорости загрузки страниц

Скорость загрузки страниц является важным фактором ранжирования, в особенности в поисковой системе Google.

Для обеспечения удобства работы пользователей необходимо стремиться у следующим показателям скорости загрузки страниц:

- CLS не выше 0,1

- LCP не выше 2,5 сек.

- FID не выше 100 мс.

При низкой скорости загрузки страниц рекомендуем следовать рекомендациям сервисов.

Сервисы для проверки:

Анализ скорости ответа сервера

Желательно время скорости загрузки сервера 200-300 мс. Если скорость ответа сервера ниже, рекомендуем увеличить скорость загрузки сервера.

Скорость ответа сервера напрямую влияет на скорость загрузки страниц.

Анализ изображений

Необходимо проверить вес изображений. Оптимальный вес для картинок – 100-200 кб.

Желательно использовать современные форматы изображений:

- Lля оформления значков, иконок и других подобных элементов рекомендуем использовать векторные изображения в формате .svg

- Lля растровых изображений (картинок) рекомендуем использовать форматы .png, .jpeg, .jpg

У изображений должен быть корректно заполнен атрибут alt.

Для улучшения индексации изображений рекомендуем сгенерировать xml-карту для картинок и разместить её в корневой папке сайта.

Проверка наличия иконки Favicon

Favicon – значок веб-сайта, который отображается в поисковой выдаче и в заголовке окна в браузере.

Наличие иконки Favicon – одна из рекомендаций Яндекса.

Иконка размещается на каждой странице в header.

Стандартный размер иконки, поддерживаемый большинством браузеров и устройств — 16×16 px в формате .ico.

Проверка наличия заголовков Last Modified и If-Modified-Since

Рекомендуем настроить заголовки Last Modified и If-Modified-Since.

HTTP заголовок Last-Modified сообщает клиенту (браузеру, поисковому роботу) время последнего изменения страницы. Если клиент получил заголовок Last-Modified, то при следующем обращении к адресу, при условии, что страница есть в локальном кэше, он добавит запрос If-Modified-Since (не изменилась ли страница после даты, полученной в Last-Modified). В свою очередь, сервер, получив запрос If-Modified-Since, должен сверить полученную временную метку с временем последнего изменения страницы и, если страница не изменялась, ответить 304 Not Modified.

Таким образом, если поисковый робот получит ответ 304 Not Modified, то он не будет обходить страницу, а будет обрабатывать только страницы с изменениями, тем самым повышая эффективность обхода сайта.

Анализ AMP и Турбо страниц

После внедрения микроразметки https://schema.org/Article для страниц статей, рекомендуем настроить для статей Турбо-страницы для Яндекса и AMP страницы для Google. Внедрение данных технологий позволит увеличить скорость загрузки страниц.

Подробнее с технологиями AMP и Турбо можно ознакомиться по ссылкам: Справка Google

Проверка индексации контента с отключенными JavaScript

Весь контент должен быть оформлен в html-коде и размечен соответствующими тегами.

Критично важно, чтобы в html-коде отображался следующий контент:

- Мета-теги title, description, h1

- Заголовки h2-h6

- Все ссылки (в том числе атрибуты ссылок)

- Вся графическая информация (изображения и теги для изображений alt и title)

- Весь текстовый контент (в том числе дополнительные элементы: навигационные блоки, меню и т.д.)

- Текст кнопок

- Микроразметка Schema.org

- Выпадающее меню в шапке

При загрузке страницы необходимо сначала загружать весь контент, шрифты и стили, затем скрипты.

Дополнительный функционал, например всплывающие баннеры и т.д., необходимо загружать после первого взаимодействия с сайтом.

Для проверки доступности контента необходимо отключить JavaScript через расширение браузера и изучить код страниц без скриптов. Все ссылки, тексты, изображения и другой важный контент должны отображаться в коде.

Также проверить как видят сайт поисковые роботы с JS и без JS можно с помощью нового инструмента Яндекс Вебмастера Рендеринг страниц JavaScript (β).

Проверка валидности html-кода

Необходимо проверить код на наличие ошибок, которые могут затруднять взаимодействие пользователей с сайтом и ухудшать внешний вид страниц.

Например:

- Неработающие кнопки

- Незакрытые теги

- Фрагменты html-кода на страницах сайта

- Слетевшая верстка элементов

Проверка наличия и корректности составления микроразметки Schema.org

Микроразметка данных необходима для того, чтобы улучшить представление сайта в поисковых системах и сделать сниппет более привлекательным. При наличии микроразметки поисковые системы на свое усмотрение могут подтянуть в сниппет дополнительную информацию, которая может быть полезна пользователям, например:

- Цены

- Номер телефона

- Рейтинг и количество отзывов

- Навигационную цепочку ссылок

Необходимо проверить, присутствует ли на сайте микроразметка данных и нет ли ошибок в микроразметке.

Примеры стандартных элементов, которые необходимо разметить микроразметкой:

- Хлебные крошки – https://schema.org/BreadcrumbList

- Рейтинг – https://schema.org/AggregateRating

- Контакты – https://schema.org/Organization

- Новости – https://schema.org/NewsArticle

- Товары – https://schema.org/Product

- Отзывы – https://schema.org/Review

- Статьи – https://schema.org/Article

Заключение

Наличие технических ошибок может негативно влиять на ранжирование сайта и давать преимущества вашим конкурентом. Кроме того, технические ошибки могут ухудшать поведенческие факторы, затрудняя взаимодействие пользователей с сайтом. Поэтому необходимо регулярно проводить технический аудит сайта.

Здравствуйте, уважаемые читатели блога KtoNaNovenkogo.ru. Как я уже не раз говорил, да и вы сами знаете, что главное в сайте — это контент (его наполнение, содержимое). Все остальное является второстепенным и неважным. Стоп. Второстепенным да, но все равно очень важным.

То как оформлен контент, во что он завернут, как подается и как все это выглядит с точки зрения поисковых систем — очень важно. Это не даст вам какую-то немыслимую фору относительно конкурентов (при условии, что они аудит сайта проводят регулярно), но позволит встать с ними на одну ступень (сравняться с голодными).

SEO сейчас включает в себя целый ряд факторов разной степени важности (об этом еще отдельно поговорим). Например, для Яндекса на первом месте тексты, а для Гугла по-прежнему в приоритете ссылки (без них рост трафика маловероятен). Но если на сайте имеются ошибки технического или структурного типа, хромает юзабилити и тянет вниз поведенческие факторы, то добра от этого не жди.

Сайтам, продвигающимся по коммерческим запросам следуете в аудит (что это?) добавлять еще и инвентаризацию наличия всех коммерческих факторов (а их немало), без которых сейчас в этой области вообще делать нечего. В общем, много за чем нужно следить, а вот за чем именно будет детально рассмотрено ниже по тексту. На самом деле — все очень и очень просто.

С чего начать аудит сайта?

Сначала пару слов о том, кому и зачем это может быть нужно. Если говорить коротко, то всем у кого есть сайты и кто хочет, чтобы росту их популярности (посещаемости) ничто не мешало. Это может быть только что созданный сайт или проект, который существует давно.

Аудит показан и одностраничникам и монстрам в миллионы страниц (последние, кстати, отдачу от проверки почувствуют в большей мере). Аудит нужен всем. Другое дело, что проводить его могут профи с приличными ценниками, а можете сделать и вы сами, сформировав в конце список задач для вашего программиста (если такового нет, то биржи фрилансеров ждут ваших предложений с нетерпением).

В принципе, ничего сложного в этом нет. Посидите часок-другой за компьютером, составите по моим лекалам задания на доработку, поищите на биржах исполнителей (правда, это не так просто, ибо там много посредников) и все. При желании можете и сами все это править, но тут уже парой часов не обойдетесь, хотя я ссылочки все же оставлю для особо пытливых умов.

В принципе, с чего начинать аудит не так уж и важно, ибо все пункты чек-листа необходимо выполнить, а уже в каком порядке роли не играет. Отсутствие на сайте ошибок, мешающих продвижению — это комплексная величина и она достигается только комплексной и всеобъемлющей проверкой. Поехали.

Стоп, еще пару слов отступления надо сказать. Дело в том, что есть сайты, которые продвигаются только по информационным запросам (мой блог тому яркий пример). Им по жизни проще, ибо конкуренция в выдаче не столь высока и поисковики некоторые огрехи прощают, а на что-то вообще внимания не обращают.

Но есть сайты, на которых продвигаются еще и (или в основном) коммерческие запросы, а вот тут в выдаче идет настоящая рубка. Для таких сайтов продвижение — это хождение по минному полю. Здесь важно все: и объемы текста, и вхождение ключей, и расположение элементов сайта, и структура разделов и так называемые коммерческие факторы (телефон нужного формата, контакты как у других и т.п.).

Зачем я это говорю? А затем, что аудит будет универсальный, подходящий для коммерческих и информационных сайтов. Если запросы, продвигаемые на вашем сайте информационные, то вы просто опустите те пункты, которые необходимы для продвижения запросов коммерческих. Для вас это будет лишнее. Ну а продающим сайтам нужно будет проходить все пункты этого чек-листа неукоснительно.

Вот, а теперь уж точно поехали…

Проверка на блокировку регуляторами интернета (Роскомнадзор)

В современных реалиях это очень важно. Под блокировку может попасть как ваш сайт (целиком или только отдельные страницы), так и сайт сидящий с вами на одном IP (виртуального хостинга или CDN).

Проверить сайт на наличие в базах Роскомнадзора довольно просто:

- eais.rkn.gov.ru/

Если обнаружили, что таки да, и ваш ресурс в этом списке найден, то надо будет немедленно начинать переписку с Роскомнадзором (hotlinerkn@rkn.gov.ru) для выяснения причин и скорейшего выполнения условий для того, чтобы из этого списка вас вычеркнули.

Даже если под санкции РКН попала только одна страница вашего сайта, вовсе нет гарантии, что только она и будет заблокирована. Часть интернет-провайдеров просто не заморачиваться и блокируют весь сайт.

Если своего сайта в этих списках вы не нашли, то это вовсе не означает, что он блокировки не подвергается. Если у вас виртуальный хостинг без выделенного IP или вы используете CDN (особенно если это что-то бесплатное на манер КлоудФлера), то высока вероятность быть заблокированным не за свои грехи.

Поэтому во избежание такой участи лучше отказаться от использования бесплатных CDN (да и платных тоже) и потратиться на получение выделенного IP для вашего сайта.

Проверка кроссбраузерности сайта

Как вы понимаете, пользователи на ваш сайт могут заходить с совершенно разных обозревателей (только основных браузеров вот сколько). К тому же сейчас очень большая доля трафика идет с мобильных устройств (уже более половины от всего потока посетителей). Естественно, что вам нужно точно знать, что с отображением вашего сайта в этих браузерах тоже все в порядке.

Как это проверить? Ну, можно скачать себе Хром, Мазилу, Оперу, Яндекс Браузер, Сафари, IE и другие. Смотреть в них нужно не только отображение главной страницы, но и другие показательные для вашего сайта страницы (со статьями, с карточками товара, с листингом товара, с контактами). То же самое и для браузеров на популярных мобильных устройствах (Андроиде и iOs).

Есть и более универсальный вариант — онлайн-сервис BrowserShots. Он бесплатный, но вполне себе функциональный. Поддерживает большое число браузеров, а на выходе выдает скриншоты вашего сайта сделанные в выбранных вами обозревателях. Работает не быстро, но вполне сносно.

Если что-то где-то пойдет не так (поедет дизайн, не подключатся стили, что-то перекосится), то пишите первым пунктом в задание программисту: добиться правильного отображения сайта в таких-то браузерах.

Валидация Html и CSS

Этот этап аудита чем-то сродни предыдущему. Валидация кода и CSS стилей нужна не сама по себе (для галочки), а именно для того, чтобы избежать возможных проблем с отображением сайта, которые зачастую визуальными методами выявить бывает совсем непросто.

Тем более что мудрить тут особо не нужно. Есть официальные валидаторы от консорциума W3C (он отвечает за формирование стандартов современно языка разметки), в которые просто нужно будет добавить адрес страницы вашего сайта:

- Валидатор HTML кода

- Валидатор CSS кода

Опять же, вы должны понимать, что через валидаторы нужно прогонять не только главную страницу, но и другие «показательные». Например, страницы со статьями, страницы с товарами, со списком товаров (или статей) и т.д. На каждой из них могут быть свои ошибки и замечания.

Что делать с найденными ошибками? Ну, не паниковать, это точно. Если сами понимаете где нужно поправить, то в путь. Но зачастую для исправления ошибок в коде разметки придется копать глубоко и лезть в код движка или плагинов (расширений). В этом случае даете задание программисту: убрать по возможности все ошибки, выдаваемые валидаторами для «показательных» страниц вашего сайта.

Проверка адаптивности сайта

Как я уже говорил, более половины трафика в рунете уже идет с мобильных устройств. Поэтому хотим мы этого или не хотим, но наши сайты должны уметь «красиво сжиматься» (адаптироваться) к экранам гаджетов с низким разрешением. В противном случае вы просто убьете на корню поведенческие факторы вашего замечательного сайта, которому для показа на экране мобильника потребует горизонтальная прокрутка.

Какими же способами на этом этапе аудита выявить проблему или убедиться, что ее нет? В принципе, вы можете просто открыть ваш сайт на своем мобильнике и все увидеть воочию. Есть отличный сервис IloveaDaptive (рекомендую). Или еще проще — прямо на компьютере уменьшайте размер окна браузера схватив его мышью за угол. Появляется горизонтальная прокрутка? Картинки вписываются в новые размеры?

Если вы сузили экран в десятки раз, а текст, картинки, кнопки и прочее оформление успешно адаптируется к такому размеру (перестраивается), то это уже замечательно. Но даже если там вам покажется все хорошо — это еще не значит, что все будет хорошо и для поисковых систем. Лучше подстраховаться и посмотреть на сайт глазами поисковых систем.

У Гугла есть специальный тест, проверяющий оптимизацию любого сайта под мобильные устройства:

Тут тоже лучше будет проверить все «показательные» страницы, чтобы убедиться в полном отсутствии проблем с адаптивностью на всем вашем сайте.

У Яндекса тоже есть подобный инструмент, но доступен он только из панели для вебмастеров на вкладке «Инструменты» — «Проверка мобильных страниц»:

Что делать, если ваш сайт в ходе аудита не прошел тест на адаптивность? Не паниковать, но брать ноги в руки и искать решение. Лично я сделал свой сайт адаптивным самостоятельно и даже подробно описал сей процесс.

Но это вовсе не обязательно делать самому. Адаптация под мобильные устройства не такая уж и сложная задача для программиста (верстальщика), так что просто добавьте еще один пункт в свое техзадание сформулированное по результатам этого аудита. Я бы рекомендовал делать именно адаптацию, а не отдельную мобильную версию сайта.

Аудит микроразметки

Микроразметка — это необходимый атрибут оптимизации сайта при продвижении по коммерческим запросам. Размечаются карточки товаров, контакты, телефоны и все такое прочее. Она скрыта от глаз обычных пользователей и добавляется программно в Html-код в виде дополнительных атрибутов.

Зачем она нужна? Ну, чтобы поисковики четко и безошибочно понимали, что тут что. Микроразметкой вы буквально тыкаете пальцем поисковику — вот цена, а вот фотография товара, а вот контакты продавца, а вот его телефон.

Зачем это нужно поисковым системам? Ну, как же, по этим признакам они оценивают коммерческие факторы сайта (об этом будет отдельная статья) и решают — брать его в «обойму» доверенных продавцов или это фуфел (дорвей, например) маскирующийся под коммерческий сайт.

Данные из микроразметки могут попадать в сниппет (описание вашего сайта в выдаче поисковиков) и быть дополнительным привлекающим элементом. В общем, для коммерческих сайтов микроразметка обязательна, но далеко не факт, что она у вас выполнена безошибочно.

Как проверить микроразметку? Опять же довольно просто ибо и в Гугле, и в Яндексе для этой цели предусмотрены валидаторы микроразметки:

- Проверка микроразметки на ошибки в Яндексе

- Проверка структурированных данных в Гугле

Аудит вашего сайта по этому пункту чек-листа будет заключаться лишь в подстановке Урлов страниц, где требуется проверить микроразметку на ошибки.

Главное тут, как мне кажется, это страница с контактами. Обязательно должны быть размечены название компании, почтовый адрес, индекс, контактный телефон, факс, электронная почта. Если там чего-то не хватаете или есть ошибки в микроразметке, то КФ (коммерческие факторы) вашего сайта могут быть занижены Яндексом со всеми вытекающими.

Проверка кодировки

Браузеры сейчас очень умные и умеют автоматически различать кодировки русского языка, коих очень много. Но самым верным вариантом будет указать тип используемой кодировки в самом начале Html кода всех страниц сайта. Так вы на 100% защититесь от кракозябров (нечитаемых символов, отображаемых вместо букв русского языка).

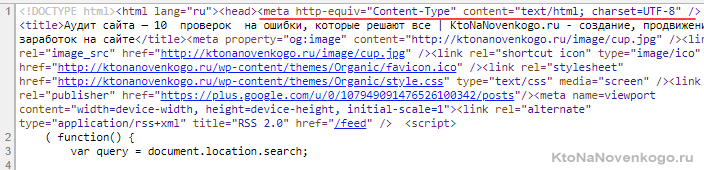

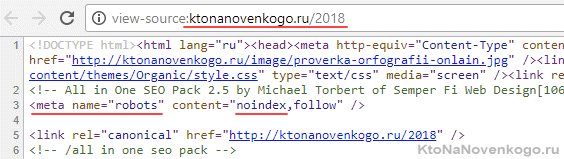

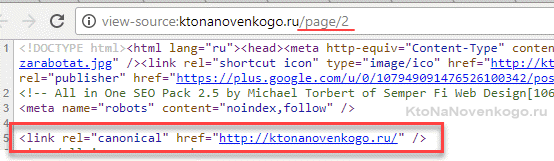

Аудит по этому пункту чек-листа будет довольно простым. Открываете любую страницу сайта в любом браузере и кликаете по пустому месту на странице правой кнопкой мыши. Выбираете из контекстного меню пункт вида «Посмотреть код страницы» (либо нажмите Ctrl+U на клавиатуре) и в открывшемся окне ищите в самом верху сразу после директивы DOCTYPE конструкцию (называется метатег) задающую кодировку:

<meta http-equiv="Content-Type" content="text/html; charset=UTF-8" />

У меня в коде это именно так и выглядит:

Вместо UTF-8 у вас может стоять windows-1251 — не суть важно, хотя все же юникод (UTF) сейчас считается признанным стандартом (для нового сайта лучшие его использовать).

Если такой строки в исходном коде страниц вы не нашли (можно воспользоваться поиском по странице «Ctrl»+F), то нужно будет его туда добавить. В большинстве используемых движков сделать это совсем несложно. В Вордпресс, например, этот код можно дописать в файл header.php из папки с используемой вами темой оформления. Ну а для программиста — это вообще минутное дело (просто добавьте это в составляемое по результатам аудита ТЗ).

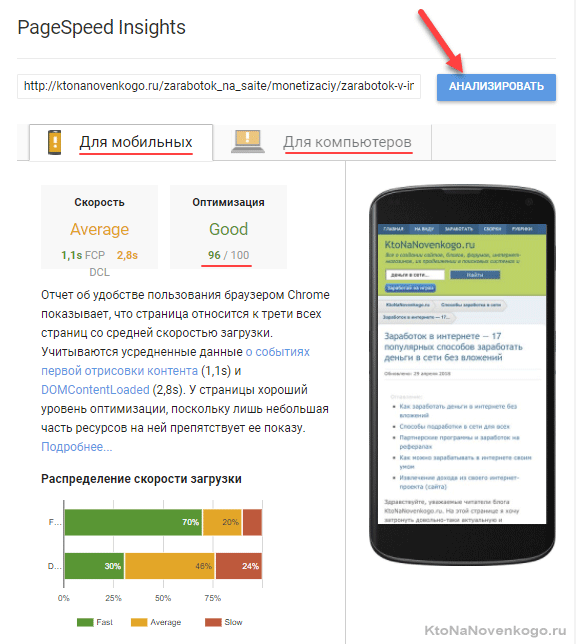

Аудит скорости загрузки сайта

Скорость загрузки страниц уже давно стала фактором, влияющим на продвижение сайта. Особенно это актуально сейчас, когда большая часть трафика идет с сотовых телефонов, а мобильный интернет ведь далеко не всегда «хорошо ловит». А посему именно у мобильных пользователей косяки в настройках сайта выливаются в очень долгую загрузку страниц.

Реально более 4 секунд ждать никто не будет. Поисковики это дело фиксируют и принимают меры. Но сначала проблему надо диагностировать.

Понятно, что вы может измерить скорость загрузки сайта десятком различных способов вплоть до того, что называется «на глазок», открывая новые страницы сайта в браузере, где вы его еще не открывали до этого или после того, как почистили кеш браузера. Но это все не то, ибо требуется взглянуть на проблему со стороны поисковиков.

В этом плане отличным инструментом аудита может послужить сервис Гугла по оценке скорости загрузки сайта под названием PageSpeed Insights:

Как и ранее не устаю повторять — проверять нужно не только главную страницу, но и все другие «показательные» (созданные по разным шаблонам) страницы. Результаты теста должны быть хотя бы хорошими, а в идеале — отличными. Я шел к таким результатам лет пять, наверное. Так долго, что теперь уже и радости никакой нет от достижения отличного результата.

Но вы, естественно, не обязаны сами мучиться над повышением скорости работы сайта, ибо это реально сложное дело требующее познаний не только в программировании, но и в тонкой настойке веб-сервера. Просто добавьте в ваше ТЗ программисту пункт о том, что такой-то перечень страниц должен выдавать при их аудите в PageSpeed Insights отличный или хотя бы хороший результат.

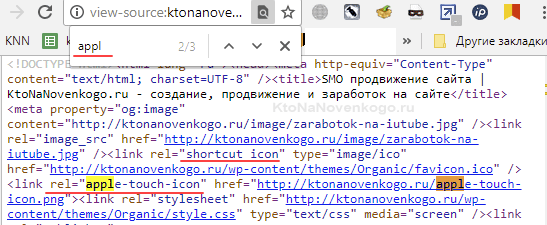

Проверка фавикона

Фавикону уже много лет и тот формат, в котором он изначально задавался (ico) уже давно морально устарел (его полностью вытеснил PNG). Однако favicon.ico живее всех живых.

На большинстве сайтов для этой цели используется графический файл-иконка, сохраненная именно в устаревшем формате ico. Размер его обычно равен 16 на 16 пикселей (у меня именно так), но можно сделать и больше (32 на 32, например, использует Авито). Яндекс же для этой цели использует файл в формате png размера 64 на 64. У Гула ico размера 32 на 32. В общем, кто в лес, кто по дрова.

Что такое фавикон, как его создать и как подключить я уже довольно подробно писал. Если кратко, то он отображается в выдаче Яндекса рядом с названием вашего сайта и на вкладкахзакладках браузера. Задать его можно просто добавив строку кода туда же, где мы только что кодировку смотрели:

<link rel="shortcut icon" type="image/ico" href="https://ktonanovenkogo.ru/wp-content/themes/Organic/favicon.ico" />

У Яндекса это выглядит чуть по-другому (но он может, по идее, нарушать все мыслимые правила):

<link rel="shortcut icon" href="//yastatic.net/iconostasis/_/8lFaTHLDzmsEZz-5XaQg9iTWZGE.png">

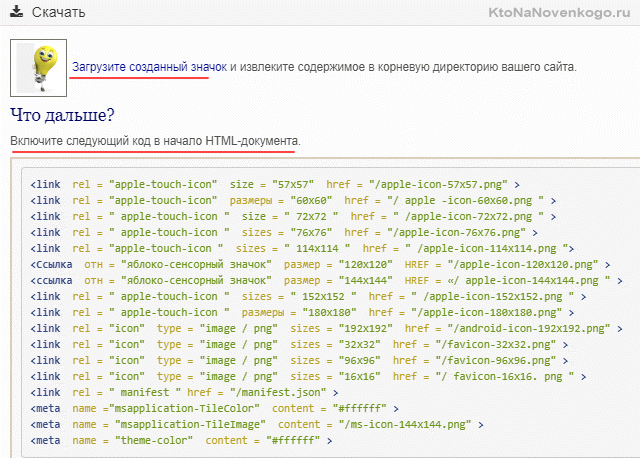

Но это не все. Вы еще не слышали про Apple Touch Icon? Нет? Я вот тоже недавно об этом услышал. И знаете в чем тут дело? Это оказывается специальная иконка, которая будет отображаться на мобильном устройстве, если ваш сайт вытянули на «хом скрин» (аналог рабочего стола в iOs).

Проблема еще и в том, что на разных устройствах от Эпл этот файлик требуется разного размера (от 57 на 57 пикселей до 180 на 180). Кроме iOs иконки формата «Apple Touch Icon» несмотря на название поддерживают и устройства на Андроиде. Какие там размеры нужны вообще непонятно.

На официальной странице для Эпл-разработчиков на данный момент предлагается два варианта указания мест хранения Apple Touch Icon — задать общую для всех иконку или несколько для каждого размера. Мне второй вариант кажется слишком громоздким (четыре записи добавлять), поэтому я выбрал первый вариант с указанием пути до иконки (она должна быть в формате PNG) размером 180 на 180 пискселей:

<link rel="apple-touch-icon" href="https://ktonanovenkogo.ru/apple-touch-icon.png">

Если ничего из вышесказанного про фавикон и Apple Touch Icon вы не поняли, а в исходном коде сайта (Ctrl+U) поиском по странице (Ctrl+F) ничего подобного («shortcut icon» и «apple-touch-icon») не нашли, то просто скопируйте этот текст вашему программисту и скажите ему: «чтоб было».

Есть, кстати, отличный сервис «Генератор иконок Favicon«, который из одной загруженной вами картинки сделает весь необходимый набор изображений, которые вы сможете скачать одним архивом.

Мало того, он вам даже код для подключения всех этих красивостей к сайту предоставит. Правда, их там уже очень много получается, но вы всегда вольны чем-то пожертвовать ряда компактности исходного кода страниц вашего сайта.

Аудит карты сайта в формате sitemap.xml

Поисковые системы безусловно умнеют из года в год, но тем не менее нелишним будет им однозначно „показать пальцем“ на те страницы вашего сайта, которые необходимо проиндексировать. Для этого предусмотрен файл так называемой карты сайта, который обычно называют sitemap.xml и размещают в корне сайта (именно там его в первую очередь будут искать боты Яндекса и Гугла).

Файл sitemap.xml в идеале должен обновляться с появлением новых страниц на сайте (в указанной чуть выше статье я упоминал про плагин для Вордпресс, который оперативно создает карту блога). В этом файле должны содержаться страницы, которые подлежат индексации поисковыми системами.

Могу поделиться с вами несколькими лайфхаками по sitemap.xml, которые можно использовать:

- Не стоит тупо помещать sitemap.xml в корень сайта и указывать путь до него в файле роботс.тхт (о нем мы еще ниже поговорим). Почему? Ну, зачем упрощать жизнь тем, кто ворует ваш контент (а такие всегда найдутся).

Лучше спрятать этот файл поглубже и назвать по-другому (jfhfhdk.xtml, например). После этого просто идете в панель Гугла и Яндекс Вебмастер, чтобы указать там путь до этого файла. Все. Поисковики в курсе, а остальные пусть утрутся.

- Если у вас огромный сайт с большим числом страниц и большой их вложенностью, то, наверняка, имеются проблемы с его индексацией. Есть масса способов как загнать страницу в индекс (все те же IndexGator или GetBot) и удержать ее там (сквозной блок со случайным списком страниц), но можно и sitemap.xml для этой цели использовать.

Дайте задание вашему программисту, чтобы в файл карты сайта добавлялись только страницы, на данный момент не попавшие в индекс или выпавшие из него. Это ускорит доступ к ним ботов поисковиков, ибо они не будут отвлекаться на уже проиндексированные странички.

В общем, данный этап аудита заключает в том, чтобы убедиться в наличии на сайте в любой момент времени актуального файла карты всех страниц подлежащих индексации. Если его нет, вы его не нашли или вам он не понравился — пишите очередной пункт в ТЗ программисту. Для него все это как два пальца…

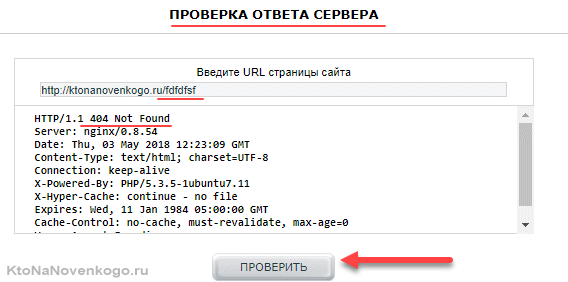

Проверка ответа на ошибку 404

Никто не идеален и уж тем более те, кто будет ставить ссылки на ваш сайт на блогах, форумах, в соцсетах и других местах. Людям свойственно ошибаться. А одна ошибка в URL-адресе страницы ведет к тому, что ваш сервер (где живет сайт) ответит на такой запрос (переход по битой ссылке) кодом 404. Обычное дело, но…

Очень плохо, если эту ошибку будет обрабатывать браузер и выдаст пользователю белый лист с мелкой надписью „404 not found“. В этом случае этот посетитель будет для вас потерян. Такие ошибки должен обрабатывать сам сервер и выдавать страницу 404 ошибки в дизайне вашего сайта, что сильно повысит вероятность того, что пользователь этот все же найдет у вас что-то интересное (на вашу радость). Понятно?

Как проверить? Просто добавьте к адресу вашего сайта через слеш любую белиберду типа „https://ktonanovenkogo.ru/fdfdfsf“ в адресной строке браузера и смотрите на результат. Видите белый лист с мелкой надписью? Пишите очередной пункт ТЗ для программиста или настраивайте 404 страницу сами, например, опираясь на приведенную выше статью.

Второй важный момент. Нужно убедиться, что ваш веб-сервер (это не тот сервер, что в стойке хостера стоит, а программа веб-сервер) выдает в ответ на запрос несуществующих страниц именно код 404. Если он выдает на них код 200, то беда. Будет много непонятных и ненужных проблем.

Как проверить код ответа? Есть масса сервисов. Например, в составе Яндекс Вебмастера или этот вот. Вставляете в него адрес страницы, которой точно нет на сайте (типа „https://ktonanovenkogo.ru/fdfdfsf“) и смотрите на код ответа вашего сервака:

Если там не 404, то прям срочно связываетесь с программистом и просите в экстренном порядке все поправить. На самом деле, этот пункт аудита очень важен, ибо чреват очень неприятными последствиями.

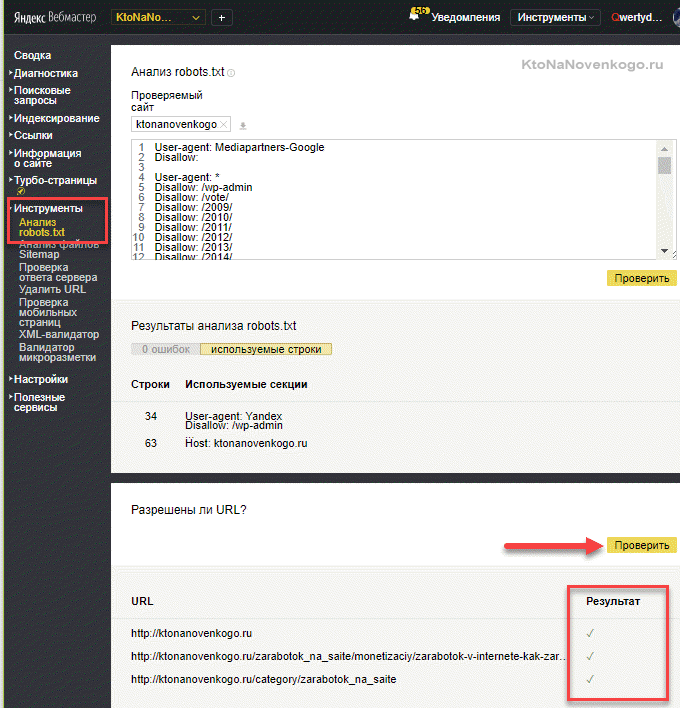

Аудит файла Robots

Испокон компьютерных веков поисковые роботы прежде чем начать обход сайта ищут сначала в его корне файл robots.txt. В нем обычно указывают директивы для поисковых ботов, которые либо запрещают индексирование каких-то страниц и разделов (например, тех, где лежат файлы движка), либо разрешают индексацию, например, поддиректории в запрещенной для индексации директории.

Подробнее про robots.txt и мета-тег роботс читайте в приведенной по ссылке статье. В принципе, этот файл может быть пустой либо его может не быть вовсе. Поисковики, конечно же, сумеют со временем (с годами) разобраться в том, что у вас мусор, а что „ценный контент“. Но как и с файлом sitemap.xml — лучше, если поисковому боту „показать пальцем“.

Robots.txt служит в основном для указания — туда ходи, сюда не ходи (а тут рыбу заворачивали). Это не значит, что бот туда действительно не пойдет (гуглобот вообще везде ходит), но вы свою задачу выполнили и технические файлы (движка, темы оформления, скриптов) в индекс лезть не будут и время на их индексацию бот, скорее всего, тратить не будет.

Тезисно по проверке robots.txt:

- Аудит имеющегося у вас файла нужно проводить в панели Гугла и Вебмастере Яндекса.

Вводите адреса „показательных“ страниц и убеждаетесь, что они доступны для индексации. Потом вводите адреса технических файлов (папок) и убеждаетесь, что они закрыты для индексации. Главное правильно подобрать страницы и ничего не упустить из важного. Если что-то не так, как надо, то добавляйте пункт в ТЗ программисту.

- Раньше в robots.txt требовалось добавлять в отдельном блоке для Яндекса главное зеркало сайта с помощью директивы Hosts. Недавно Яндекс это дело отменил, но директиву многие по-прежнему прописывают.

- Также многие добавляют в Роботс путь до карты сайта в формате xml. Но чуть выше мы с вами пришли к выводу, что лучше не палиться и не облегчать жизнь копипастерам.

- Директивы, запрещающие индексацию в файле Роботс.тхт не означают того, что бот не перейдет на эти страницы и не проиндексирует их. Особенно наплевательски к таким директивам относится Гугл.

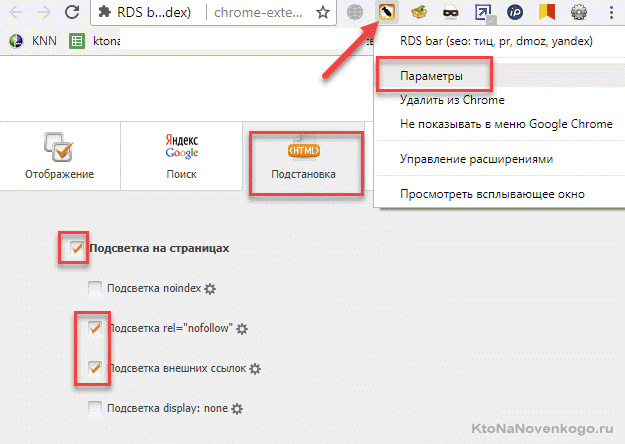

Если хотите 100% закрыть страницу от попадания в индекс добавьте в ее html код мета-тег robots (см. скрин). Например, у меня страницы с временными архивами закрыты именно так (через плагин ОлИнСЕоПак).

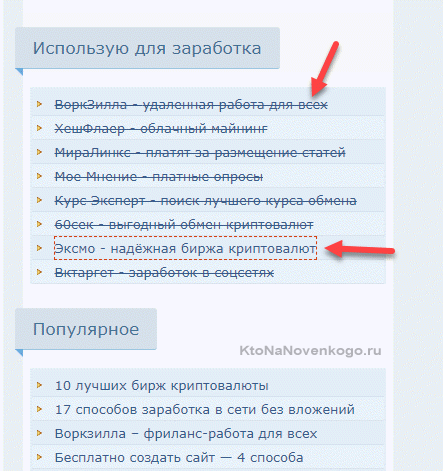

В мета-теге robots значение „noindex“ запрещает индексировать этот документ (страничку, то есть ее содержимое), а „follow“ разрешает переходить боту по имеющимся на ней ссылкам (но можно даже и это запретить). Подробнее смотрите в приведенной выше статье по Роботсу.

Проверяем заголовки и альты у картинок

В html предусмотрены уровни заголовков от H1 до H6, которые использовать на странице очень желательно именно в порядке убывания. Главный заголовок — это H1. Не стоит даже ради красоты сначала ставить H3 потом H1, а потом H2. Порядок — есть порядок.

Другое дело, что многие хитрят и делают большие надписи (аля главные заголовки) вообще не заголовками, а обычными блоками (используются, например, теги div вместо H1), размер и вид текста в которых задается просто с помощью CSS.

Дело в том, что в этой надписи (в отличие от H1) не нужно употреблять ключевые слова и ее можно сделать максимально притягательной и не нагруженной ключами. А сам H1 может идти ниже и визуально будет выглядеть как рядовой заголовок или вообще как фрагмент текста.

Уже дальше пойдут H2 (а как их подразделы — H3, если до этого дойдет), которые при продвижении под коммерческие запросы лучше ключами вообще не засорять — LSI фразы для них будут в самый раз. О них подробнее поговорим в отдельной статье, но если кратко, то это фразы употребляемые экспертами в данной области, а не теми, кто в этом ничего не петрит.

Ну, вы поняли? В принципе, это общая практика и хорошо работает особенно на продающих страницах, где главное склонить покупателя к действию крупными и яркими зазывными текстами, а для поисковиков использовать в скромно оформленном H1 (и тайтле) ключевые фразы (надо опять же смотреть на конкурентов из Топа по этому запросу).

Очень часто содержимое H1 совпадает с содержимым Тайтла (что такое тайтл и дескрипшен читайте по ссылке). В принципе, H1 дает возможность вариации использования другой версии ключа, а для информационных запросов, когда кластер ключей для одной страницы огромен, заголовки всех уровней дают возможность использовать как можно больше ключевых слов для увеличения трафика на статью.

На данном же этапе аудита вам главное выяснить — соблюдается ли иерархия заголовков на основных типах страниц (главной, категориях, статьях, карточках товаров) вашего сайта и везде ли есть H1. Для этой цели отлично подойдет плагин для браузеров Веб Девелопер, который наглядно может показать все используемые на странице заголовки. Можно и просто подводить мышь к заголовку и из меню правой кнопки выбирать пункт „Посмотреть код“ (или „Исследовать элемент“), но это будет не так быстро и наглядно.

Очень часто теги H2-H6 могут использоваться разработчиками шаблона в оформлении темы (заголовках меню, например). Лучше это все убрать, чтобы заголовки были только в уникальной части данной конкретной страницы (в ее теле, а не в обвесе).

Касаемо атрибутов Alt и Title у используемых на сайте изображений (в теге Img). Атрибуты Alt должны быть прописаны обязательно (их содержимое будет отображаться вместо картинки, если ее браузеру не удастся подгрузить), а Title — по желанию (его содержимое показывается при подведении мыши к изображению на странице сайта).

Внимание! Сейчас в Альтах категорически нельзя спамить ключевыми словами, уповая на то, что их дескать не видит посетитель, а потому туда пихают неочеловеченные n-граммы типа „холодильник купить Москва“. Множество сайтов за это попали под фильтр.

Зачастую владельцы добавляли ключи даже к изображениям, относящимся к дизайну сайта (логотипам, стрелочкам и тому подобной мишуре). Сейчас Alt должен только описывать то, что изображено на картинке (ну, может еще с использованием LSI фраз — о них напишу отдельную статью).

Как проводить аудит альтов? Чтобы найти страницы, где атрибутов Alt вообще нет, можно использовать уже упомянутый выше Валидатор HTML кода. Он отсутствие альтов отмечает именно как ошибку. Чтобы проверить содержимое тегов Альт отлично подойдет уже упомянутый выше плагин для браузеров Веб Девелопер (он умеет отображать содержимое альтов для всех картинок на странице прямо рядом с изображением).

Естественно, что при нахождении расхождений — правите их сами либо добавляете очередной пункт в ТЗ программисту.

Аудит Seo-тегов для всех страниц сайта

Какие SEO теги существуют? Ну, изначально их было три: Title, description и keywords. Однако, keywords уже давным-давно стал рудиментом. Представляете, изначально он был придуман, чтобы поисковики понимали, по каким запросам ваш сайт ранжировать (добавлять в Топ). Глупые они тогда были.

Что главное в рамках этого этапа аудита:

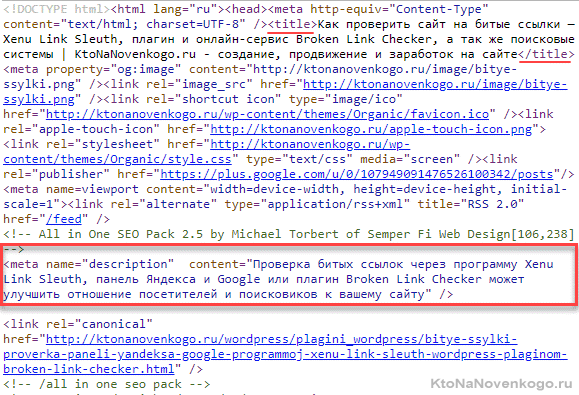

- Во-первых, Title и description должны быть (какие именно читайте в приведенной выше статье). В смысле, наличествовать. Страница без Title считайте что не существует для поисковиков. Description тоже важен, но уже не так. О таких страницах (без тайтлов) вам с радостью расскажут Гугл и Яндекс Вебмастер в блоках с найденными ошибками. Также это наглядно можно увидеть с помощью такой бесплатной программы, как Xenu Link, если отсортировать собранные ею данные по столбцу „titile“ (увидите пустые ячейки).

- Во-вторых, не должно быть одинаковых Тайтлов у страниц в рамках одного сайта. Они должны хоть чем-то отличаться, даже если это карточки с похожими товарами. О таких ошибках вам опять же сообщат в панели вебмастеров Яндекса и Гугла (у меня таких ошибок нет, а посему скрин привести не могу, но вы покопайтесь сами). Если сайт небольшой, то одинаковые теги Title вы и с помощью Xenu Link сможете выявить.

Если сайт совсем маленький, то можно посмотреть Тайтлы и Дескрипшены вручную просто нажав Ctrl+U на клавиатуре (посмотреть исходный код страницы):

Что делать, если ошибки такого рода были найдены? Если это статьи или карточки товаров, то просто измените чутка Тайтлы или настройте автоматическую их генерацию для карточек на основе шаблона.

У меня такая проблема была на страницах с пагинацией (типа главной на этом блоге, где внизу есть нумерация). Я просто закрыл страницы пагинации от индексации (через мета-тег Роботс) и добавил на всякий случай к ним мета-тег Каноникал указывающий первую страницу как каноническую.

Если ничего не поняли, то программист поймет обязательно и быстро решит для вас выявленные на этом этапе аудита проблемы. А иначе зачем вы ему деньги платите?

Проверка склейки зеркал

Поисковики такие глупые, что считают некоторые совершенно одинаковые на наш взгляд страницы разными. Например, для Яндекс и Гугла страницы со слешем и без слеша в конце будут разными:

https://ktonanovenkogo.ru

и

https://ktonanovenkogo.ru/

А также доменное имя сайта с www и без www для них воспринимают как два разных сайта:

https://ktonanovenkogo.ru

и

https://www.ktonanovenkogo.ru